RAG: Afrontando el Desafío de la Precisión en Agentes de IA para Escenarios de Alto Riesgo

Aunque los Agentes de IA tienen un inmenso potencial para automatizar los flujos de trabajo empresariales, la volatilidad inherente de los Modelos de Lenguaje Grandes (LLMs) plantea un riesgo significativo en industrias altamente reguladas como las finanzas, el derecho y la salud. Un solo resultado incorrecto puede desencadenar graves consecuencias legales o financieras.

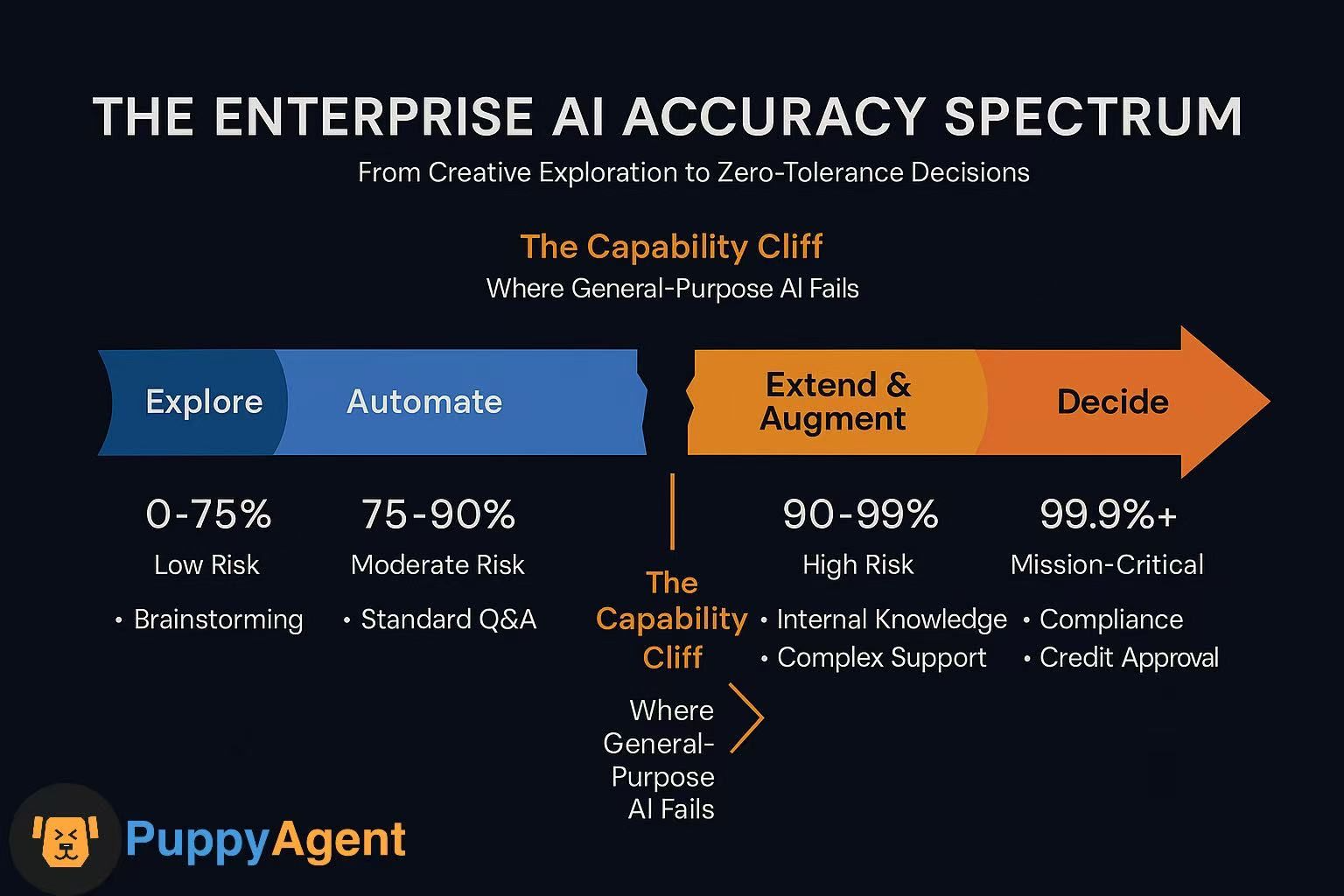

Para gestionar sistemáticamente los riesgos impulsados por la IA y desbloquear el valor empresarial, los líderes primero necesitan un marco claro para evaluar los requisitos de precisión de diferentes casos de uso. El marco de "Niveles de Precisión de Casos de Uso de IA" a continuación clasifica las aplicaciones de IA según su precisión requerida y su tolerancia al riesgo.

| Nivel de Precisión | Precisión Requerida | Casos de Uso Típicos | Riesgos Potenciales |

|---|---|---|---|

| Nivel 1: Tolerancia Cero | 99.9%+ | Diagnósticos médicos, cumplimiento legal, aprobación de crédito financiero, AML | Riesgos catastróficos legales, financieros o de seguridad |

| Nivel 2: Alto Riesgo | 90-99% | Soporte al cliente complejo, gestión del conocimiento interno, evaluación de riesgos de suscripción | Pérdidas comerciales significativas, abandono de clientes, problemas de cumplimiento |

| Nivel 3: Fiabilidad Contextual | 75-90% | Chatbots de servicio al cliente estándar, análisis de tendencias del mercado, sistemas de preguntas y respuestas | Mala experiencia de usuario, ineficiencia operativa |

| Nivel 4: Creativo y Exploratorio | 0-75% | Generación de contenido, lluvia de ideas, asistentes personales | Resultados de baja calidad o inutilizables |

El Costo Empresarial de la Inexactitud de la IA: Cuantificando el Riesgo

La inexactitud de la IA ya no es solo un problema técnico; es un riesgo sistémico importante que exige supervisión ejecutiva. Para comprender su profundo impacto empresarial, debemos cuantificar los costos.

Impacto Financiero

- $67.4 mil millones - Pérdidas globales atribuidas a "alucinaciones" de IA en 2024 (estudio AllAboutAI 2025)

- Casi el 50% de los usuarios de IA empresarial admitieron haber tomado decisiones comerciales importantes basadas en contenido generado por IA potencialmente inexacto

Costos Operativos

- Caída promedio del 22% en la eficiencia del equipo debido a la verificación manual de los resultados de la IA (Boston Consulting Group 2025)

- $14,200 por empleado anualmente - Costo de los esfuerzos de mitigación de alucinaciones (Forrester Research)

Elección Tecnológica Estratégica: RAG vs. Ajuste Fino (Fine-Tuning)

Para habilitar los casos de uso de Nivel 1 y Nivel 2, un Agente de IA debe tener una fuente de conocimiento incuestionablemente confiable. La Generación Aumentada por Recuperación (RAG) y el Ajuste Fino (Fine-Tuning) son los dos métodos principales para lograrlo.

| Factor de Decisión | Generación Aumentada por Recuperación (RAG) | Ajuste Fino (Fine-Tuning) |

|---|---|---|

| Método de Personalización | Inyecta prompts con documentos externos recuperados | Actualiza los pesos del modelo para internalizar el conocimiento |

| Actualidad de los Datos | En tiempo real; se adapta instantáneamente a la nueva información | Estático; el conocimiento se congela en el momento del entrenamiento |

| Velocidad de Despliegue | Extremadamente rápido (horas a días) | Lento (semanas a meses) |

| Explicabilidad/Auditabilidad | Alta; puede citar fuentes y proporcionar un rastro de evidencia | Baja; opera como una "caja negra" |

| Seguridad de los Datos | Alta; los datos sensibles permanecen aislados | Menor; posibles vectores de fuga de datos |

| Impacto Empresarial | Rápido tiempo de valorización, ideal para pilotos rápidos | Alta inversión inicial, largos ciclos de despliegue |

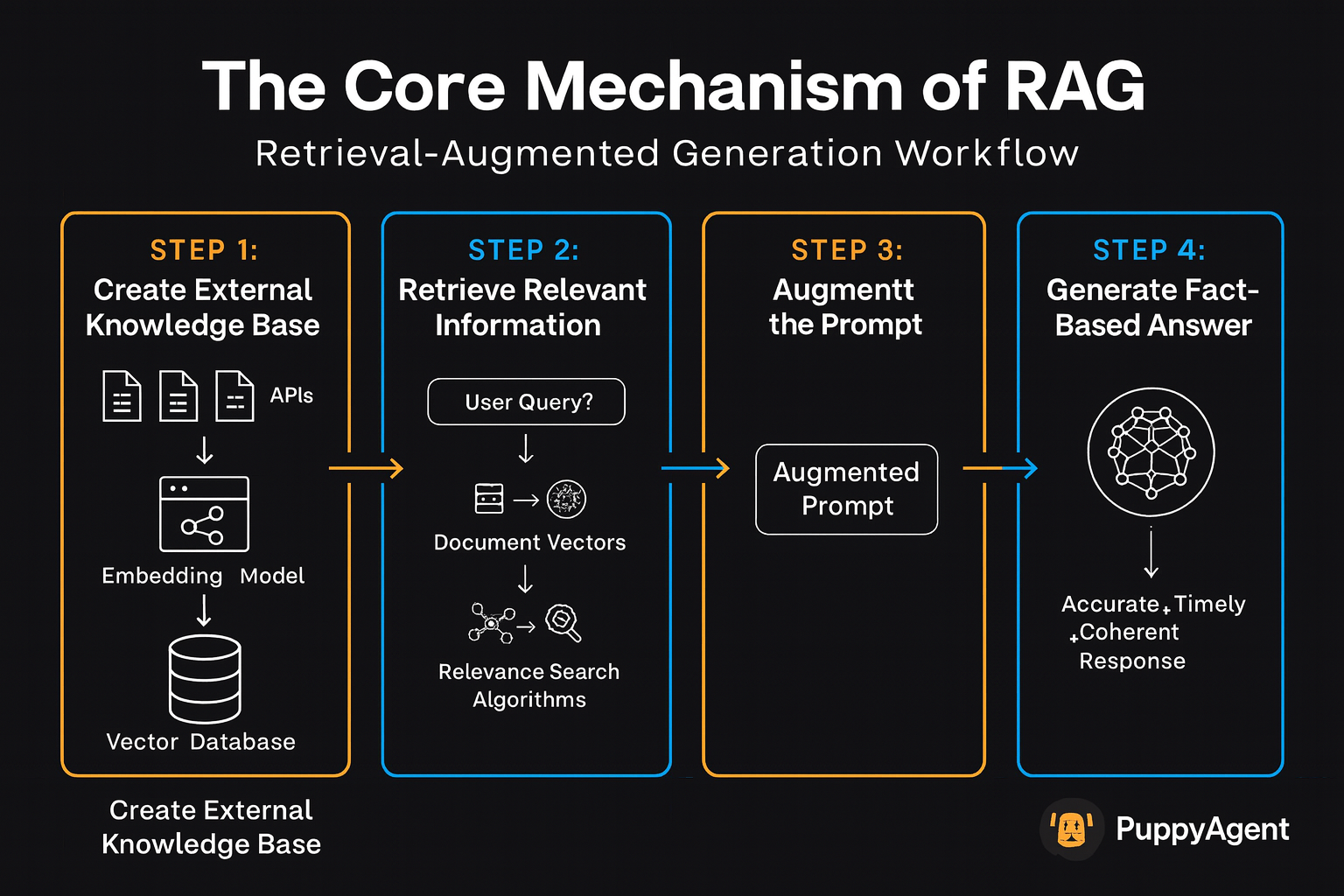

El Mecanismo Central de RAG

Un sistema RAG combina poderosamente la recuperación de información con la generación. Su flujo de trabajo generalmente sigue estos pasos:

Pasos del Flujo de Trabajo de RAG:

- Crear una Base de Conocimiento Externa - Convertir datos propietarios en vectores buscables

- Recuperar Información Relevante - Cotejar las consultas del usuario con la base de conocimiento

- Aumentar el Prompt - Integrar la información recuperada con la consulta original

- Generar una Respuesta Basada en Hechos - El LLM produce respuestas precisas y oportunas

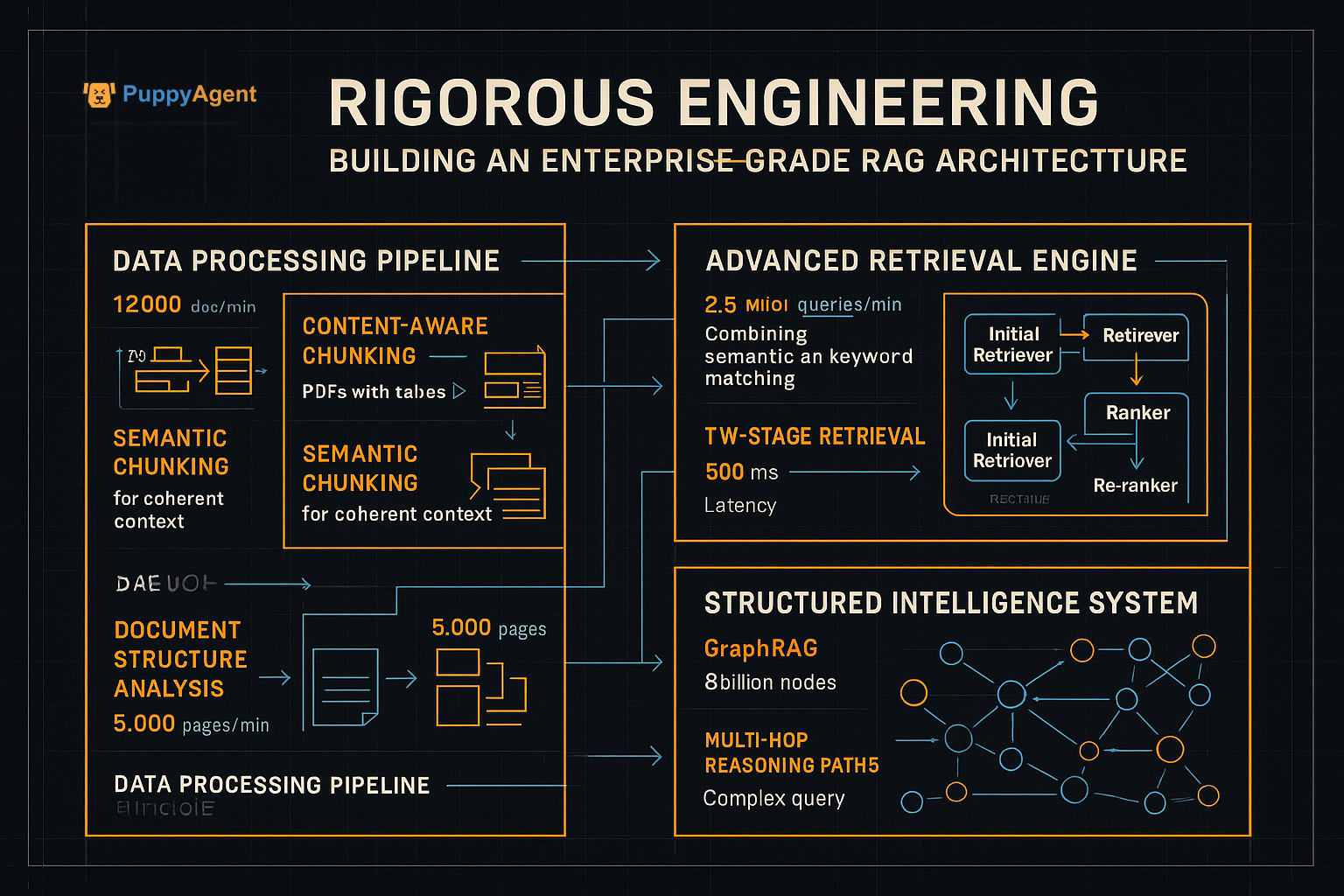

Construyendo una Arquitectura RAG de Nivel Empresarial

En un contexto empresarial, el éxito está determinado por una ingeniería rigurosa de los pipelines de datos y recuperación.

Consideraciones Clave de Ingeniería:

Fundación Centrada en los Datos

- El 80% del éxito de RAG depende de la calidad de los datos

- Fragmentación (Chunking) consciente del contenido para documentos complejos

- Fragmentación semántica para una preservación coherente del contexto

Estrategias de Recuperación Avanzadas

- Búsqueda híbrida combinando enfoques de palabras clave y vectores

- Recuperación en dos etapas con optimización de re-clasificador (re-ranker)

- GraphRAG para datos estructurados y razonamiento de múltiples saltos

Valor Empresarial Cuantificable: Estudios de Caso del Mundo Real

Eficiencia Operativa y Productividad

- Fabricante de Fortune 500: Reducción de los tiempos de respuesta del servicio al cliente de más de 5 minutos a 10-30 segundos

- Calificación de 5 estrellas del 90% por parte de los representantes de servicio

- Fabricante de automóviles de Nivel 1: Aumento del 25% en la tasa de reparación a la primera para los técnicos

Éxito en Industrias Reguladas

- Precina Health: Pacientes con diabetes redujeron sus niveles de A1c en un 1% por mes (12 veces más rápido que la atención estándar)

- Despliegue de IA médica compatible con HIPAA

Gestión del Conocimiento

- Bell (telecomunicaciones): Aseguró el acceso a las políticas más recientes para los empleados

- LinkedIn: Reducción del 28.6% en el tiempo promedio de resolución de problemas

puppyone: Plataforma de Conocimiento Empresarial para Agentes de IA

puppyone está diseñado específicamente para construir pipelines RAG de nivel empresarial, abstrayendo los complejos desafíos de ingeniería.

Propuestas de Valor Centrales:

Prototipado Rápido

- Interfaz intuitiva para la preparación de datos

- Resuelve la complejidad de "construirlo tú mismo"

Despliegue Flexible

- Soporta chatbots, APIs y widgets para sitios web

- Integración perfecta con la arquitectura de TI

Tecnología Avanzada

- Técnicas RAG de vanguardia incorporadas

- Maneja desafíos de casos de uso avanzados

Seguridad y Cumplimiento

- Seguridad de nivel empresarial

- Rastro de evidencia transparente para auditorías

Conclusión: Cerrando la Brecha entre Probabilidad y Certeza

Existe un vasto abismo entre la naturaleza probabilística de los LLMs de propósito general y las necesidades deterministas de las industrias de alto riesgo. RAG cierra este abismo al proporcionar a los LLMs fuentes de verdad externas y verificables.

El valor futuro de los Agentes de IA estará determinado por la fiabilidad, la verificabilidad y la seguridad, no solo por la potencia del modelo. puppyone ofrece a las empresas una plataforma confiable para construir sistemas de IA seguros e inteligentes que entregan un valor empresarial real mientras gestionan riesgos críticos.