FUSE AI Agents 2026: Plan/Scratch para un razonamiento fiable

Puntos clave

- Externalizar el contexto largo mediante plan.md, scratch.md, decisions.json y trace.log estabiliza el razonamiento multietapa y hace rutinaria la depuración.

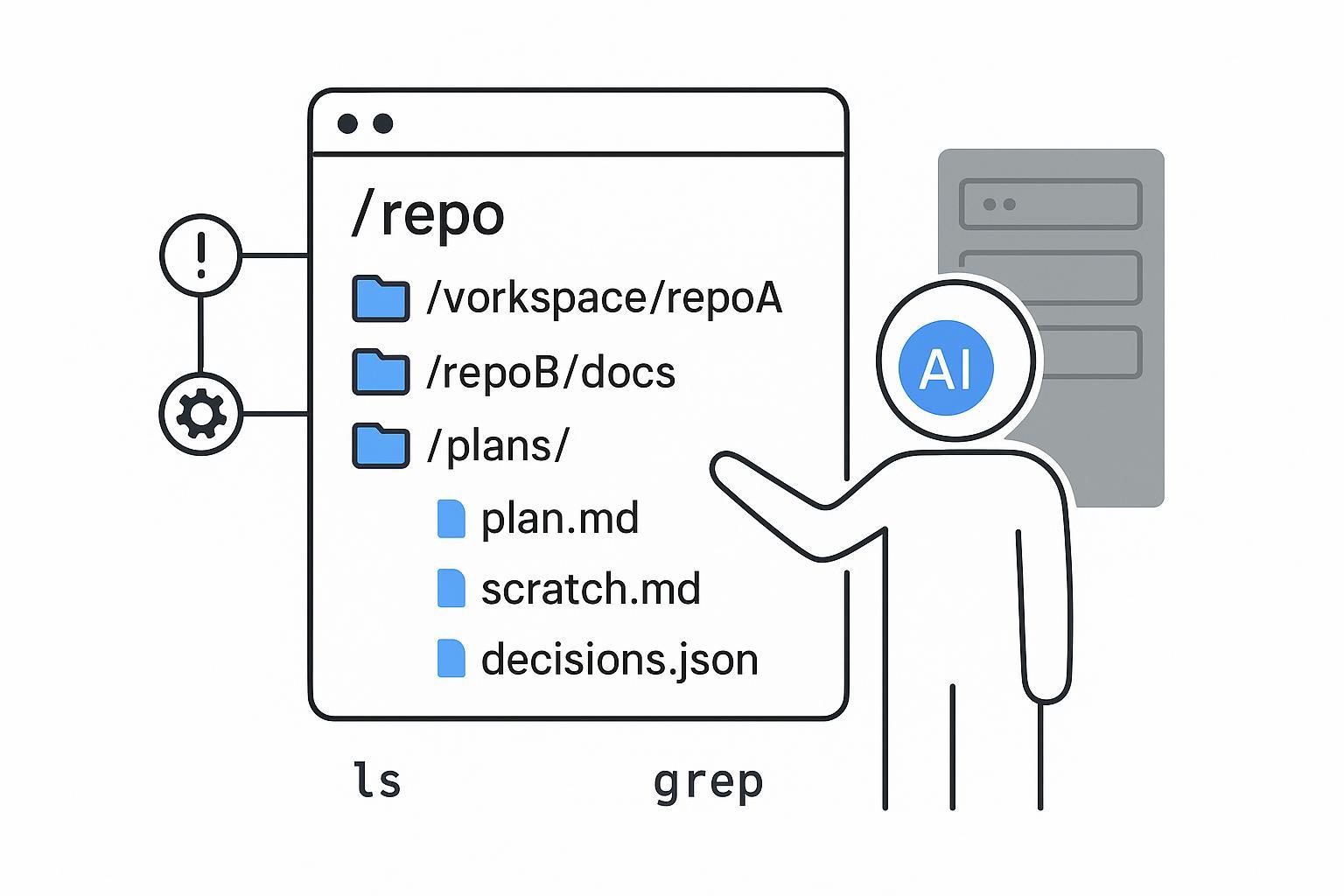

- Los montajes FUSE permiten que los agentes operen con semántica POSIX estándar (ls/grep/mv/append), reduciendo wrappers de herramientas a medida y mejorando la reproducibilidad.

- MCP actúa como puente estandarizado a sistemas empresariales mientras el sistema de archivos ofrece un espacio de trabajo local unificado; juntos permiten flujos gobernados y observables.

- Los despliegues local-first/on-prem se alinean con cumplimiento y residencia de datos; montajes por tarea y ACLs a nivel de ruta ayudan a aplicar el menor privilegio.

- Los benchmarks siguen siendo tempranos; trate las afirmaciones de rendimiento como hipótesis y priorice métodos de evaluación y observabilidad.

Por qué los archivos ganan a los prompts efímeros para contexto largo

Cuando planes, artefactos intermedios y decisiones se capturan en archivos—plan.md, scratch.md, decisions.json, trace.log—se convierten en la fuente de verdad del razonamiento en lugar de un recuerdo que se desvanece en la ventana de tokens. Los archivos aportan versionado, diffs y puntos de control. Puedes revisar cómo evolucionó un plan, revertir ramas erróneas y reproducir una ejecución desde un estado conocido. El sistema de archivos es la memoria de trabajo del agente que puedes auditar, no un hilo de prompt invisible.

El ensayo de Jakob Emmerling de principios de 2026 argumenta conceptualmente a favor de agentes “filesystem-first”, con patrones como email-como-directorios y operaciones POSIX read/write/list/move como acciones naturales. Véase “FUSE is All You Need – Giving agents access to anything via filesystems”. Para un análisis más profundo del contexto gobernado: How LLM Agent Architectures Work.

La ventaja práctica es la reproducibilidad: archivos como decisions.json y trace.log dan trazas deterministas de qué pasó y por qué. También mejoran la colaboración entre ingenieros y agentes: los humanos pueden leer plan.md, editar una sección y dejar que el agente continúe. Sin herramienta especial.

Ejemplo en ejecución — conocimiento de ingeniería multi-repo con flujos plan/scratch

Workspace concreto: /workspace/repoA, repoB/docs, patterns, plans/plan.md, scratch/scratch.md, logs/trace.log, state/decisions.json. Los agentes usan operaciones POSIX familiares (ls, grep, mv/cp, echo >>, diff/patch). Flujo de ciclo: (1) Crear o cargar plan.md con objetivos y restricciones. (2) Iterar en scratch.md: probar fragmentos, capturar hallazgos y anotar bloqueos. (3) Registrar decisiones en decisions.json con justificación y marcas de tiempo. (4) Registrar acciones en trace.log con IDs de acción del agente. (5) Promover artefactos validados y abrir PR vía MCP. Funciona bien para conocimiento de ingeniería en múltiples repos porque los agentes pueden “pensar” en archivos y operar sin adaptadores a medida; el sistema de archivos ofrece una abstracción y MCP expone sistemas externos mediante una interfaz estándar.

Patrones de implementación para agentes FUSE y interoperabilidad MCP

- FUSE solo local con sistema de archivos virtual respaldado por SQLite: adecuado para máquinas de desarrollo y pilotos pequeños. Véase propuesta AgentFS (Penberg).

- FS virtual respaldado por DB (SQLite local, Supabase o similar después): nota “AgentFS FUSE” de Turso.

- AgentFS respaldado por object store: para organizaciones grandes, desagregar almacenamiento y montar un sistema de archivos virtual con caché.

Trate MCP como el puente estandarizado a trackers de issues, CI, almacenes de documentos y servicios internos. Referencias: especificación aniversario MCP, actualización de autorización MCP, ejecución de código con MCP (Anthropic), documentación MCP de JetBrains.

Gobernanza, sandboxing y cumplimiento

Filesystem-first no significa sin control. Diseñe con menor privilegio: montajes por tarea, ACLs a nivel de ruta y registros de auditoría, controles a nivel de SO (SELinux, AppArmor, Landlock). Local-first/on-prem ayuda con residencia y cumplimiento. Alinee los alcances MCP con el mismo modelo de menor privilegio.

Observabilidad y evaluación

Trazado POSIX, métricas clave (tasa de éxito, latencia, reproducibilidad, auditabilidad), metodología de benchmark: comparar agente filesystem-first frente a cadena solo API/MCP. Más contexto sobre la “capa de contexto”: Building a RAG Model That Scales.

Limitaciones y cuándo ganan las APIs

FUSE añade mediación en espacio de usuario (más CPU y latencia). Los dominios de streaming o transaccionales pueden seguir prefiriendo SDKs/APIs directos. Patrón híbrido: sistema de archivos para plan/scratch/state y MCP para llamadas estructuradas y transaccionales.

Dónde encaja una base de contexto

Aviso: Puppyone es nuestro producto.

Una base de contexto gobernada puede sustentar esta arquitectura: conocimiento empresarial como “Know-How” estructurado (JSON/Graph), indexación híbrida, despliegue local con Docker. Context Base de Puppyone. How Agentic Process Automation Is Transforming Enterprise Operations in 2026.

Próximos pasos y recursos

Empezar pequeño: montaje FUSE local con plan/scratch en dos repos, conectores MCP para PRs/issues, trazado POSIX. Definir montajes de menor privilegio y ACLs a nivel de ruta pronto. Referencias: FUSE is All You Need, AgentFS (Penberg), Turso AgentFS FUSE, aniversario MCP, Anthropic MCP, JetBrains MCP.

FAQs

P1: ¿El overhead de FUSE impacta significativamente el rendimiento del agente?

FUSE añade latencia moderada, pero las cargas de agentes suelen ser mayormente de lectura con escrituras en ráfagas. El caché de páginas del kernel mitiga el overhead tras las lecturas iniciales. Los pilotos Turso muestran latencia <10 ms en tareas de ingeniería como grep entre repos—despreciable frente a la inferencia del LLM. Los append por lotes o particiones scratch respaldadas por RAM absorben picos de escritura. Un tradeoff de latencia del 5–15 % se justifica por la trazabilidad determinista vía trace.log y los flujos reproducibles desde checkpoints de plan.md.

P2: ¿Cómo inicio un piloto filesystem-first sin reestructurar la infraestructura?

Elija una tarea acotada de dos repos (p. ej. documentar un flujo de auth). Monte solo esos repos más directorios vacíos plans/, scratch/, logs/ con fusepy o fuse-turso en local. El agente inicializa plan.md, itera en scratch.md y escribe en trace.log. Añada un conector MCP mínimo para PRs de GitHub. Todo en un portátil de desarrollo; valide reproducibilidad y beneficios de depuración en dos semanas—sin cambios en producción.

P3: ¿Cuándo evitar filesystem-first en favor de APIs directas?

Evítelo en streaming de alta frecuencia (datos de mercado en tiempo real), transacciones ACID críticas (pagos) o tareas de un solo paso sin estado (resumen de URL). Estos exigen latencia submilisegunda o garantías transaccionales nativas que FUSE no puede ofrecer. Los patrones híbridos suelen ganar: use el sistema de archivos para plan/scratch/state y enrute las llamadas sensibles a la latencia mediante herramientas MCP con alcance. Regla práctica: si querría hacer git diff plan.md mañana para auditar una decisión, filesystem-first aporta valor.