RAG : Surmonter la crise de précision des agents IA dans les scénarios critiques

Bien que les Agents IA détiennent un immense potentiel pour automatiser les flux de travail d'entreprise, la volatilité inhérente des Grands Modèles de Langage (LLM) pose un risque significatif dans les industries hautement réglementées comme la finance, le droit et la santé. Une seule sortie incorrecte peut déclencher de graves conséquences légales ou financières.

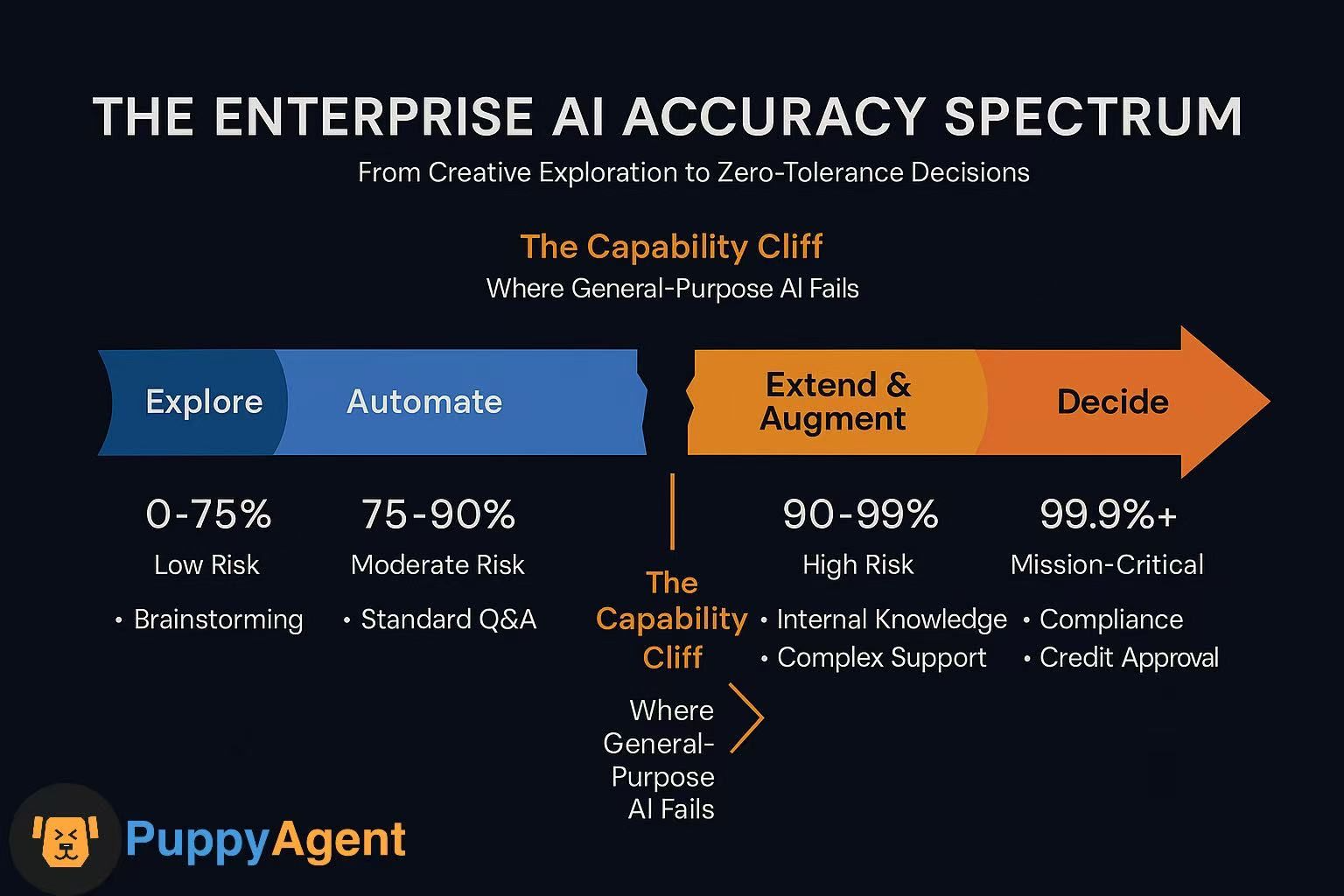

Pour gérer systématiquement les risques pilotés par l'IA et débloquer la valeur métier, les dirigeants ont d'abord besoin d'un cadre clair pour évaluer les exigences de précision de différents cas d'usage. Le framework "Niveaux de Précision des Cas d'Usage IA" ci-dessous catégorise les applications IA basées sur leur précision requise et tolérance au risque.

|| Niveau de Précision | Précision Requise | Cas d'Usage Typiques | Risques Potentiels | ||---------------|-------------------|-------------------|-----------------| || Niveau 1 : Tolérance Zéro | 99,9%+ | Diagnostics médicaux, conformité légale, approbation crédit financier, LBC | Risques catastrophiques légaux, financiers ou de sécurité | || Niveau 2 : Enjeux Élevés | 90-99% | Support client complexe, gestion connaissances internes, évaluation risques souscription | Perte métier significative, attrition client, problèmes conformité | || Niveau 3 : Fiabilité Contextuelle | 75-90% | Chatbots service client standard, analyse tendances marché, systèmes Q&R | Mauvaise expérience utilisateur, inefficacité opérationnelle | || Niveau 4 : Créatif & Exploratoire | 0-75% | Génération contenu, brainstorming, assistants personnels | Sortie de faible qualité ou inutilisable |

Le Coût Métier de l'Imprécision IA : Quantifier le Risque

L'imprécision IA n'est plus seulement un problème technique ; c'est un risque systémique majeur qui exige une surveillance exécutive. Pour comprendre son impact métier profond, nous devons quantifier les coûts.

Impact Financier

- 67,4 milliards $ - Pertes mondiales attribuées aux "hallucinations" IA en 2024 (étude AllAboutAI 2025)

- Près de 50% des utilisateurs IA d'entreprise ont admis prendre des décisions métier significatives basées sur du contenu potentiellement imprécis généré par IA

Coûts Opérationnels

- 22% de baisse moyenne d'efficacité d'équipe due à la vérification manuelle des sorties IA (Boston Consulting Group 2025)

- 14 200 $ par employé annuellement - Coût des efforts d'atténuation d'hallucinations (Forrester Research)

Choix Technologique Stratégique : RAG vs. Ajustement Fin

Pour permettre les cas d'usage de Niveau 1 et Niveau 2, un Agent IA doit avoir une source de connaissances incontestablement fiable. La Génération Augmentée par Récupération (RAG) et l'Ajustement Fin sont les deux méthodes principales pour atteindre cela.

|| Facteur de Décision | Génération Augmentée par Récupération (RAG) | Ajustement Fin | ||-----------------|------------------------------------------|-----------------| || Méthode de Personnalisation | Injecte des prompts avec des documents externes récupérés | Met à jour les poids du modèle pour internaliser les connaissances | || Fraîcheur des Données | Temps réel ; s'adapte instantanément aux nouvelles informations | Statique ; connaissances figées au moment de l'entraînement | || Vitesse de Déploiement | Extrêmement rapide (heures à jours) | Lent (semaines à mois) | || Explicabilité/Auditabilité | Élevée ; peut citer les sources et fournir une piste de preuves | Faible ; fonctionne comme une "boîte noire" | || Sécurité des Données | Élevée ; les données sensibles restent isolées | Plus faible ; vecteurs potentiels de fuite de données | || Impact Métier | Temps rapide vers la valeur, idéal pour les pilotes rapides | Investissement initial élevé, cycles de déploiement longs |

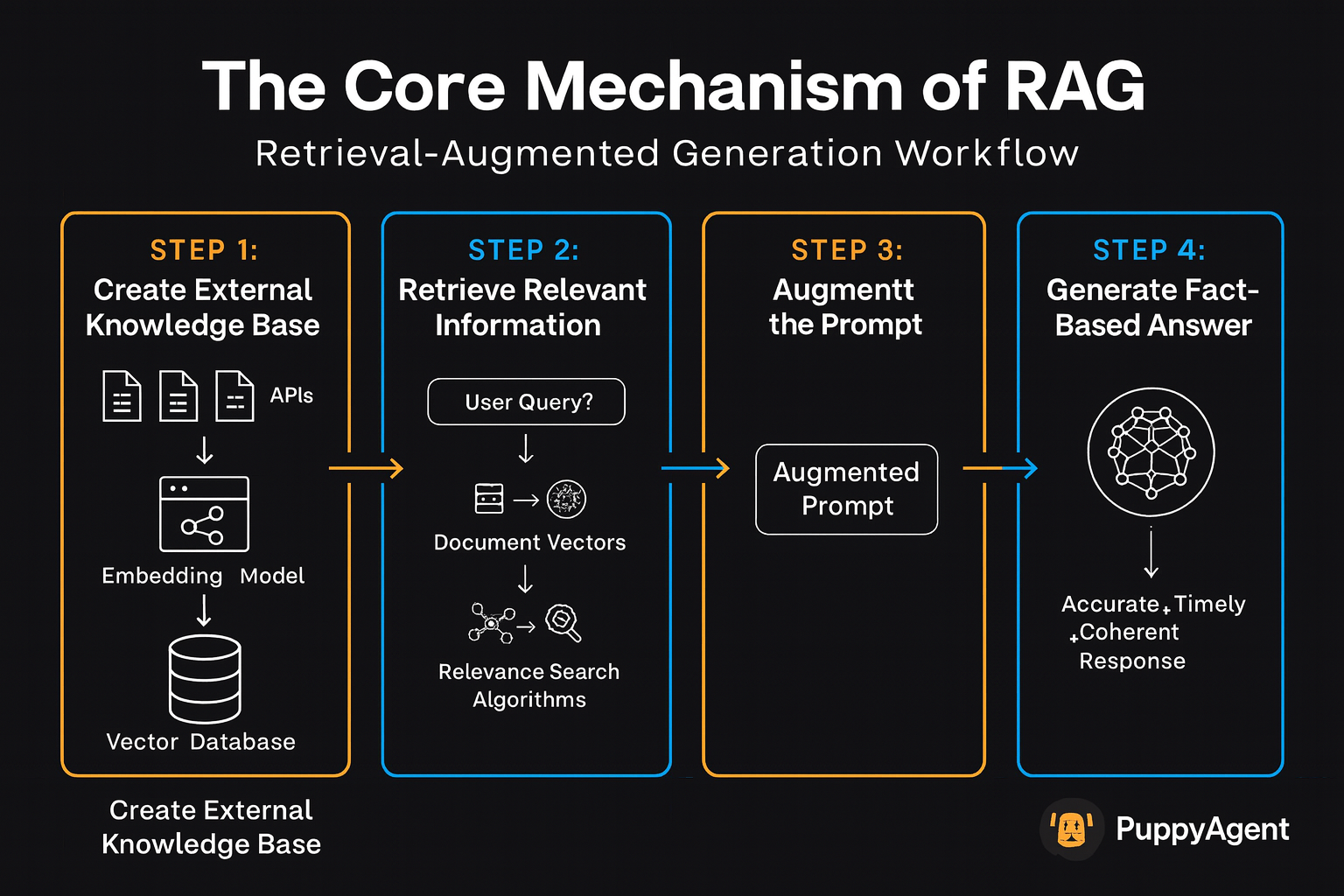

Le Mécanisme Central de RAG

Un système RAG combine puissamment la récupération d'information avec la génération. Son flux de travail suit typiquement ces étapes :

Étapes du Flux de Travail RAG :

- Créer une Base de Connaissances Externe - Convertir les données propriétaires en vecteurs recherchables

- Récupérer l'Information Pertinente - Faire correspondre les requêtes utilisateur contre la base de connaissances

- Augmenter le Prompt - Intégrer l'information récupérée avec la requête originale

- Générer une Réponse Basée sur les Faits - Le LLM produit des réponses précises et opportunes

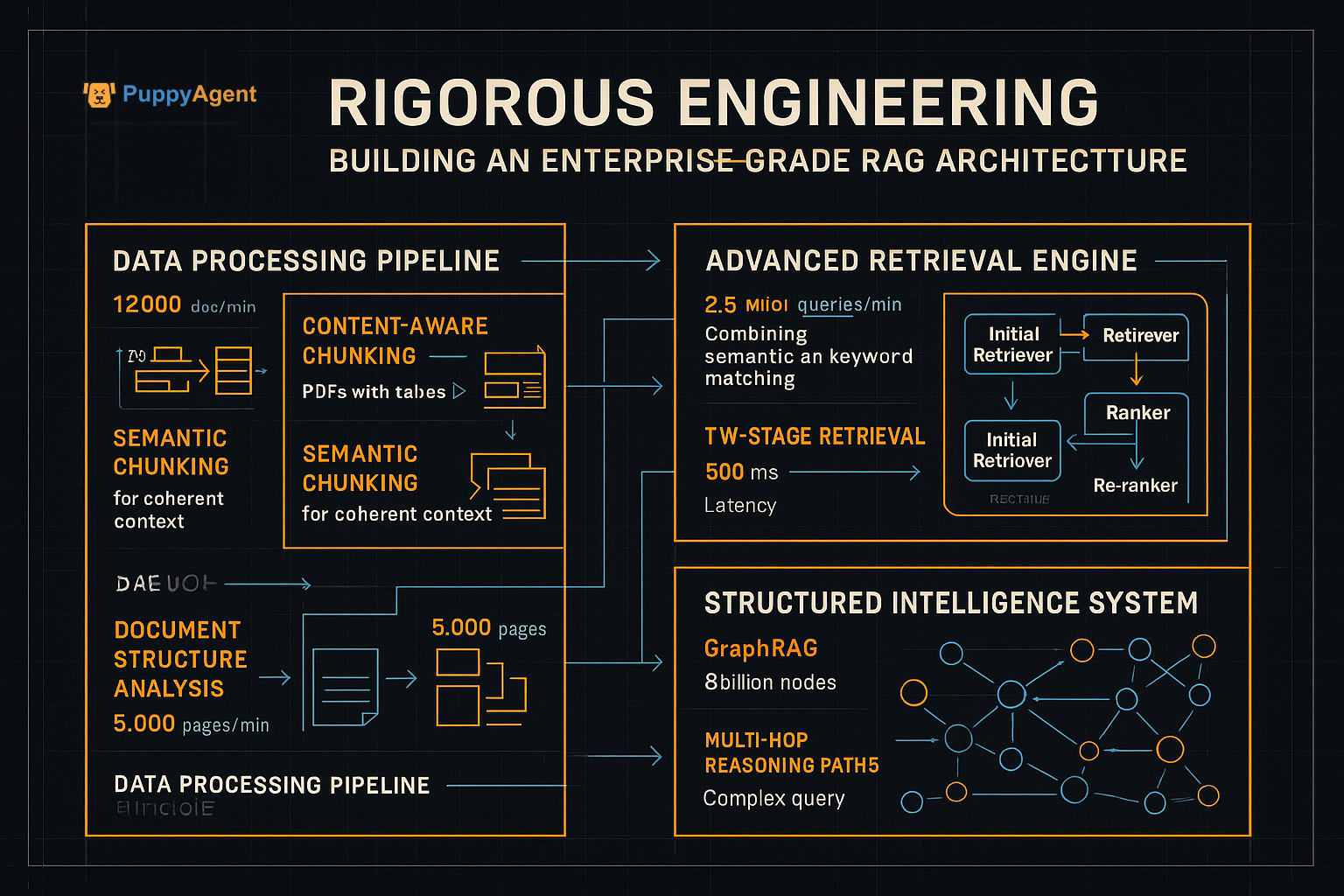

Construire une Architecture RAG de Niveau Entreprise

Dans un contexte d'entreprise, le succès est déterminé par l'ingénierie rigoureuse des pipelines de données et de récupération.

Considérations d'Ingénierie Clés :

Fondation Centrée sur les Données

- 80% du succès RAG dépend de la qualité des données

- Découpage conscient du contenu pour les documents complexes

- Découpage sémantique pour la préservation de contexte cohérent

Stratégies de Récupération Avancées

- Recherche hybride combinant approches par mots-clés et vectorielles

- Récupération en deux étapes avec optimisation de re-classement

- GraphRAG pour données structurées et raisonnement multi-saut

Valeur Métier Quantifiable : Études de Cas du Monde Réel

Efficacité Opérationnelle & Productivité

- Fabricant Fortune 500 : Réduit les temps de réponse service client de 5+ minutes à 10-30 secondes

- 90% de note 5 étoiles des représentants de service

- Constructeur automobile Niveau 1 : 25% d'augmentation du taux de résolution première fois pour les techniciens

Succès dans l'Industrie Réglementée

- Precina Health : Les patients diabétiques ont abaissé les niveaux A1c de 1% par mois (12x plus rapide que les soins standard)

- Déploiement IA médical conforme HIPAA

Gestion des Connaissances

- Bell télécommunications : Assuré l'accès aux dernières politiques pour les employés

- LinkedIn : 28,6% de réduction du temps moyen de résolution des problèmes

Puppyone : Plateforme de Connaissances d'Entreprise pour les Agents IA

Puppyone est conçu spécifiquement pour construire des pipelines RAG de niveau entreprise, abstrayant les défis d'ingénierie complexes.

Propositions de Valeur Centrales :

Prototypage Rapide

- Interface intuitive pour la préparation de données

- Résout la complexité "construisez-le vous-même"

Déploiement Flexible

- Supporte chatbots, API et widgets de site web

- Intégration transparente d'architecture IT

Technologie Avancée

- Techniques RAG de pointe intégrées

- Gère les défis de cas d'usage avancés

Sécurité & Conformité

- Sécurité de niveau entreprise

- Piste de preuves transparente pour les audits

Conclusion : Combler l'Écart Probabilité-Certitude

Un vaste gouffre existe entre la nature probabiliste des LLM à usage général et les besoins déterministes des industries à enjeux élevés. RAG comble ce gouffre en fournissant aux LLM des sources de vérité externes et vérifiables.

La valeur future des Agents IA sera déterminée par la fiabilité, la vérifiabilité et la sécurité - pas seulement la puissance du modèle. Puppyone offre aux entreprises une plateforme de confiance pour construire des systèmes IA sûrs et intelligents qui livrent une vraie valeur métier tout en gérant les risques critiques.