90% dos Agentes de IA no 'penhasco duplo': entre a generalização ineficaz e a especialização restrita

Fonte da Imagem: Puppyone

Fonte da Imagem: Puppyone

O relatório Gartner 2025 afirma que 83% dos projetos corporativos de IA falham em atender às expectativas. Enquanto a indústria de IA ainda debate os méritos de "generalistas" versus "especialistas verticais", uma realidade dura está emergindo: 90% das empresas de Agentes de IA estão presas num dilema duplo de "capacidades gerais insuficientes + falta de dados verticais". Neste dilema sem resposta certa, 90% dos projetos de Agentes estão silenciosamente caminhando para o fracasso, enquanto os sobreviventes buscam novas formas de permanecer vivos na beira do penhasco.

Penhasco Frontal: O "Penhasco de Capacidade" dos Agentes Gerais

Compreensão de intenção e seguimento de instruções são duas capacidades básicas cruciais para um Agente. Modelos fundamentais grandes tradicionais não conseguem mais atender às demandas de tarefas complexas. Agentes requerem fluxos de trabalho diversos, sistemas e controles... encapsulando os modelos base em sistemas implementáveis.

A visão de um Agente geral é tentadora—uma única entidade inteligente capaz de resolver problemas em vários campos.

Fonte da Imagem: Puppyone

Fonte da Imagem: Puppyone

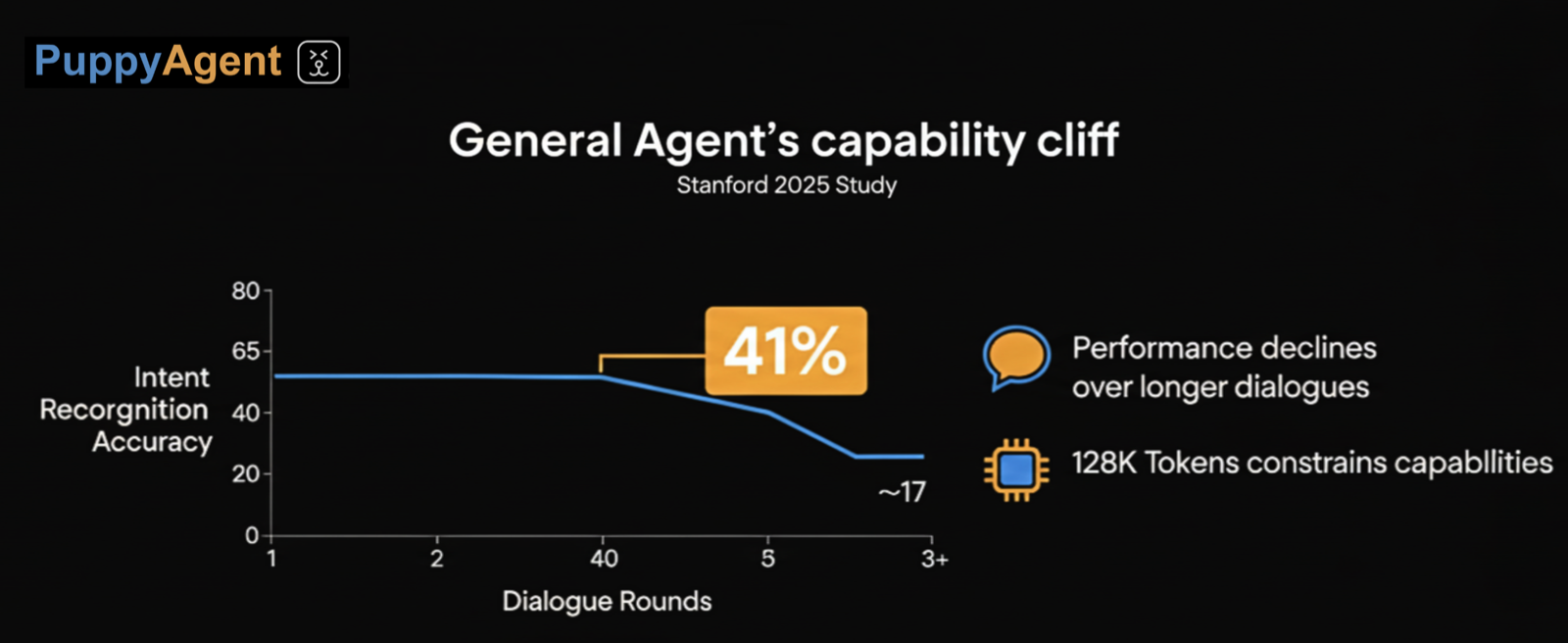

No entanto, quando a maioria das empresas tenta aplicar os chamados Agentes de IA gerais a cenários profissionais, frequentemente encontram um "penhasco de capacidade". Um teste de 2025 da Universidade Stanford revelou um fato chocante: quando as instruções do usuário excedem três rodadas de diálogo, a precisão de reconhecimento de intenção dos Agentes gerais despenca para 41%. Embora modelos como Claude tenham expandido o prompt do sistema para 128K tokens, em cenários multi-papel, esses Agentes ainda frequentemente confundem as verdadeiras necessidades dos usuários, interpretando erroneamente consultas simples como decisões complexas.

O que é mais perigoso é a armadilha de alucinações ampliadas.

Em cenários profissionais como controle de risco financeiro, a taxa de erro do conteúdo gerado por Agentes gerais é de até 52%, e esses erros são frequentemente apresentados num tom profissional, como fabricar provisões regulamentares ou inventar dados estatísticos. Um banco uma vez investiu pesadamente no desenvolvimento de um Agente geral de controle de risco, apenas para descobrir que sua taxa de erro excedeu 65% ao lidar com decisões compostas envolvendo "comportamento histórico do cliente + flutuações do mercado + mudanças de política," forçando a empresa a investir 3,2 vezes a mão-de-obra para verificação. Um experimento do MIT sobre migração cross-campo provou que quando um Agente treinado no campo médico foi transferido para um cenário legal, a taxa de aprovação da tarefa caiu de 78% para 32%. O problema central reside na não-generalizabilidade do espaço de ação—quando a interface de Uso de Ferramenta muda de uma API médica para uma API financeira, o Agente não consegue ajustar adaptativamente seu espaço de ação.

Muitas empresas estão caindo numa concepção errônea perigosa: equiparar "conseguir executar uma demo" com "ter valor comercial."

Fonte da Imagem: Puppyone

Fonte da Imagem: Puppyone

Uma montadora de carros uma vez investiu 20 milhões no treinamento de um "Agente geral de atendimento ao cliente," mas falhou em cenários reais porque não conseguia lidar com decisões compostas envolvendo "tipo de pneu + clima + hábitos de condução." Isso revela um paradoxo chave: quanto mais um Agente geral busca "onipotência," menor se torna sua confiabilidade em cenários verticais.

"Não estamos treinando agentes inteligentes; estamos vestindo alucinações com trajes profissionais." O dilema dos Agentes gerais não é que eles não conseguem fazer tudo, mas que não conseguem nem mesmo executar ações básicas de forma confiável em cenários profissionais.

Penhasco Traseiro: O "Penhasco de Recursos" dos Agentes Verticais

Quando as empresas se voltam para Agentes verticais em busca de um avanço, se encontram caindo em outro "penhasco de recursos."

Dados centrais da indústria são como tesouro trancado numa ilha: dados de diagnóstico de hospitais de primeira linha, logs de controle de risco bancário, e outros ativos chave são inacessíveis para 91% das empresas devido a barreiras de conformidade. O que é mais severo é a armadilha da qualidade dos dados. Uma equipe de IA industrial passou oito meses obtendo dados de falha de equipamentos, mas 67% foram invalidados devido a padrões de rotulação inconsistentes—dados verticais requerem know-how da indústria para serem usados corretamente. Casos reais mostram que o custo para uma empresa de IA médica obter 100.000 pontos de dados compatíveis e rotulados disparou de 830.000 yuan em 2022 para 4,12 milhões de yuan em 2024, um aumento impressionante de 400%.

Fonte da Imagem: Puppyone

Fonte da Imagem: Puppyone

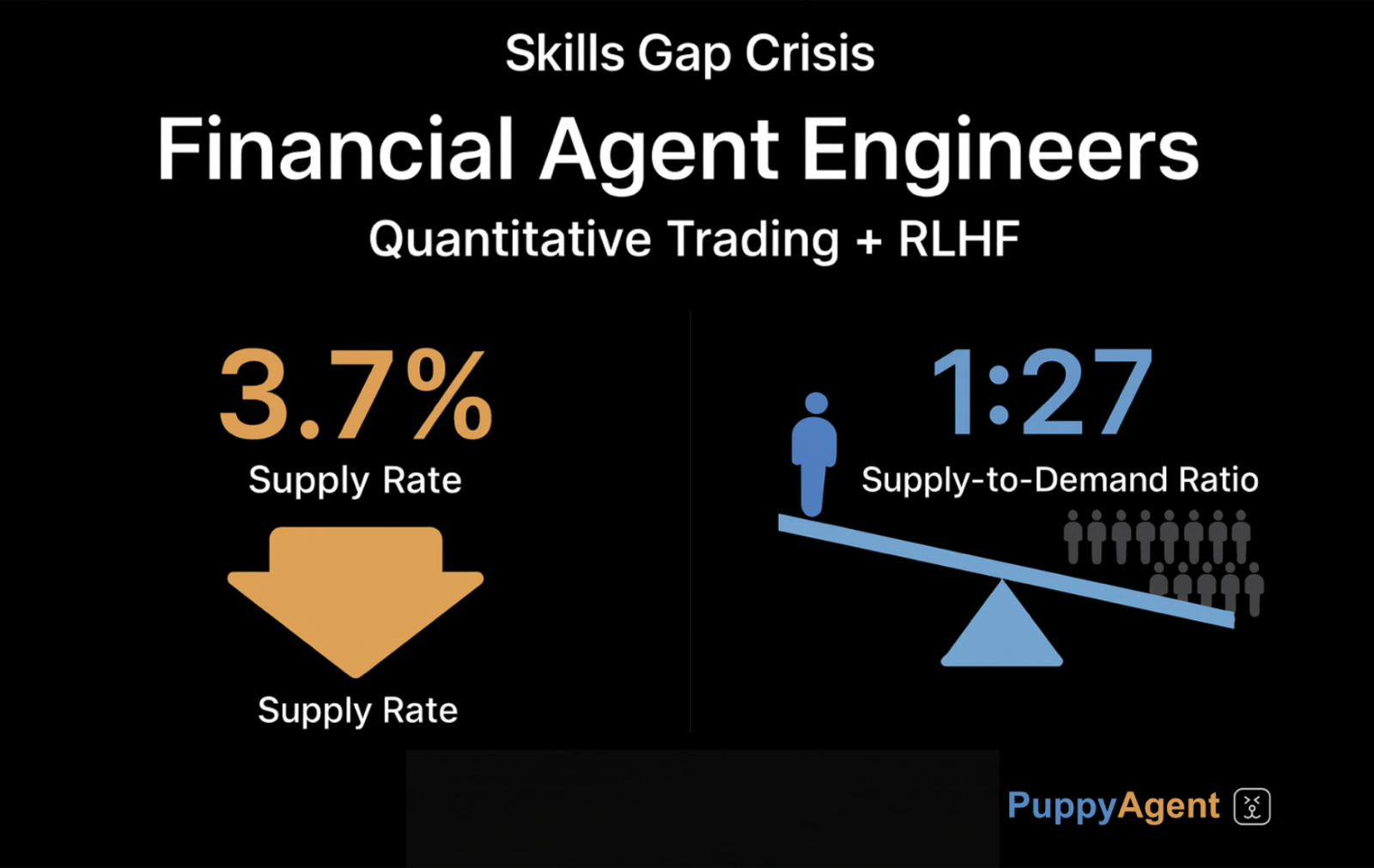

Ainda mais escassos que os dados são os talentos híbridos que podem fazer a ponte entre tecnologia e indústria. No desenvolvimento de Agentes financeiros, engenheiros que conseguem dominar tanto lógica de trading quantitativo quanto ajuste RLHF (Reinforcement Learning from Human Feedback) estão em falta, com disponibilidade de mercado de menos de 3,7% da demanda, resultando numa proporção oferta-demanda impressionante de 1:27. A quebra de comunicação entre especialistas da indústria e engenheiros de IA frequentemente leva a resultados desastrosos: especialistas da indústria produzem "fragmentos de regras" vagos baseados em experiência, que engenheiros de IA então forçam em "grafos de conhecimento errôneos," fazendo com que os Agentes finais se desviem significativamente da essência do negócio. Um cliente de manufatura solicitou o desenvolvimento de um "Agente de predição de falha de dispositivo," mas os especialistas da indústria foram incapazes de descrever as "características espectrais do ruído de rolamento" em termos técnicos, levando a um treinamento de modelo que completamente perdeu os requisitos reais.

O dilema dos Agentes verticais não é apenas sobre não conseguir obter dados, mas também sobre não conseguir entender ou usar os dados corretamente mesmo quando obtidos.

Estratégia de Sobrevivência: O Método de Avanço de Três Passos para Superar o Penhasco Duplo

Atualmente, a maioria dos modelos base depende de destilação de séries de modelos como GPT e Claude. A maioria dos dados não foi rotulada para seus próprios cenários de negócio e condições regionais/nacionais. Simplesmente construir fluxos de trabalho e adicionar RAG (Retrieval-Augmented Generation) e outros meios não pode alcançar capacidades de implementação verdadeiramente end-to-end.

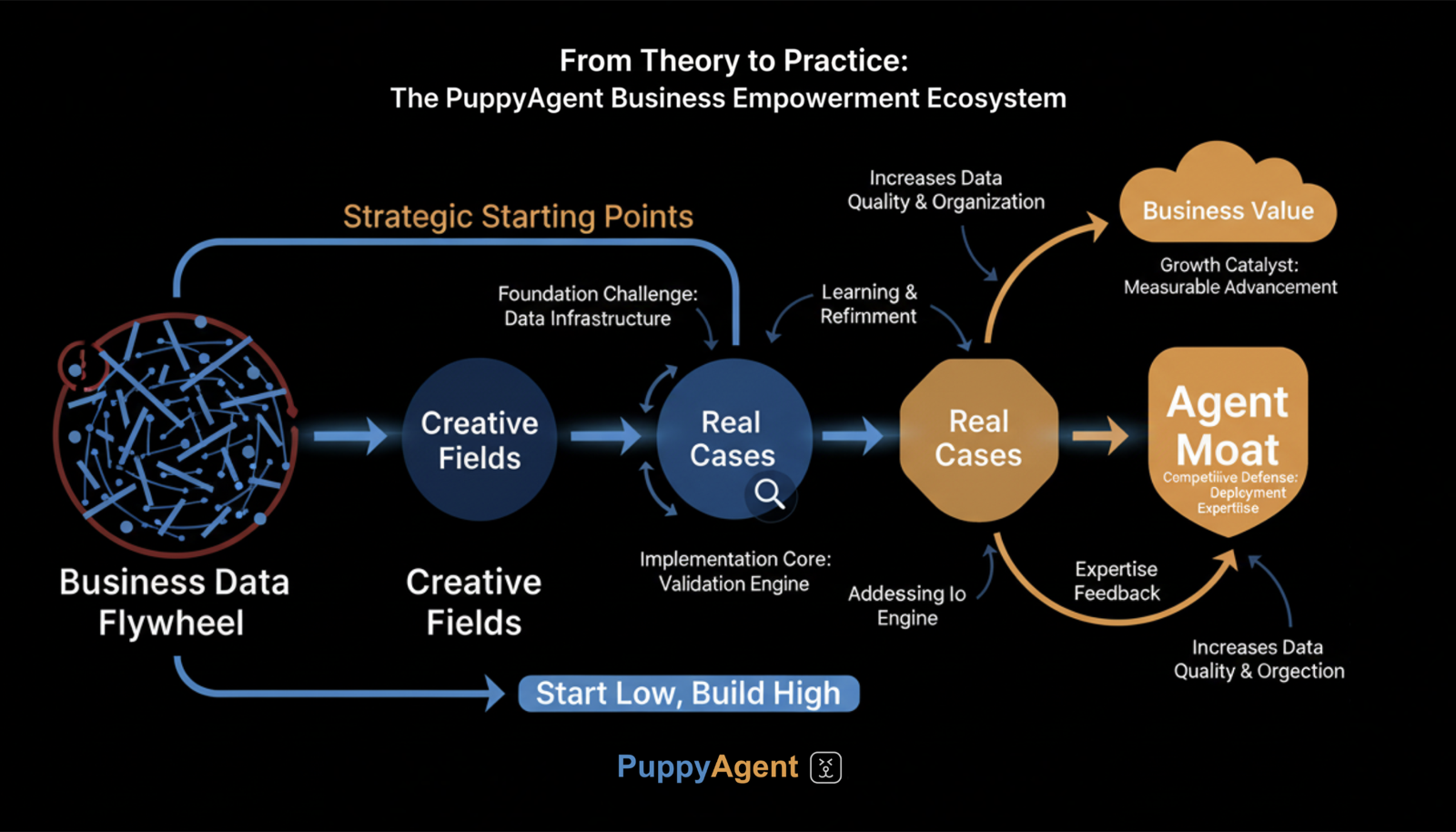

Muitas empresas ou organizações nem mesmo organizaram seus próprios flywheels de dados de negócio, muito menos impulsionar crescimento de negócio com Agentes.

Fonte da Imagem: pexels

Fonte da Imagem: pexels

Nesta situação desconfortável, o que pode ser mais importante é conseguir usar Agentes para verdadeiramente criar mais cenários de agregação de valor comercial. Se alta precisão não está disponível, pode-se começar com campos criativos que requerem menor precisão; se há falta de dados, pode-se explorar pontos de entrada de negócio com mais dados open-source. O fundamental é obter mais casos reais, para construir seu próprio fosso de Agente em combate real.

Se você também quer abandonar o trabalho complicado em mãos, por favor clique no "Começar" ao lado para explorar as possibilidades de negócio trazidas pelo puppyone.

puppyone sempre explorou o uso de RAG interativo dinâmico e Agentes para servir ao crescimento real de negócio em fluxos de trabalho. Esperamos inspirar usuários com cada caso end-to-end, em vez de nos vangloriar sobre nossa generalizabilidade, nem ficar confinados a um único cenário vertical. Agora implementamos numerosos casos em campos como atendimento ao cliente, aluguel de habitação, assuntos legais e gerenciamento de documentos. Você pode clicar para assistir os vídeos dos casos.

Conclusão

Casos e empresas excelentes todos compartilham uma característica comum: não focam mais em criar o "Agente perfeito," mas em construir um "sistema de tomada de decisão colaborativa humano-máquina," configurando trilhos de segurança em nós-chave e liberando eficiência de Agente em cenários de rotina.

Para empresas balançando na beira do penhasco, a tarefa primária é enfrentar a realidade: Agentes gerais não conseguem fazer tudo, e Agentes verticais não conseguem agarrar firmemente recursos centrais. A verdadeira saída reside no pensamento sistemático—combinando organicamente destilação de conhecimento da indústria, aprimoramento de pequenos dados, e verificação colaborativa humano-máquina para formar um "método de avanço de três passos" implementável.

Fonte da Imagem: Puppyone

Fonte da Imagem: Puppyone

Podemos perguntar repetidamente ao Manus/Genspark, se um dia OpenAI e Google realmente alcançarem Agentes gerais, onde estará sua competitividade? Podemos também perguntar à OpenAI e Google quais são as verdadeiras dificuldades em escalar cenários e generalizar fluxos de trabalho. Essencialmente, isso é uma corda bamba pendurada entre penhascos.

Sua empresa está pronta para caminhar nesta corda bamba?