RAG: Superando o Desafio da Precisão em Agentes de IA para Cenários de Alto Risco

Embora Agentes de IA tenham imenso potencial para automatizar fluxos de trabalho empresariais, a volatilidade inerente dos Modelos de Linguagem Grandes (LLMs) representa um risco significativo em indústrias altamente regulamentadas como finanças, direito e saúde. Uma única saída incorreta pode desencadear consequências legais ou financeiras severas.

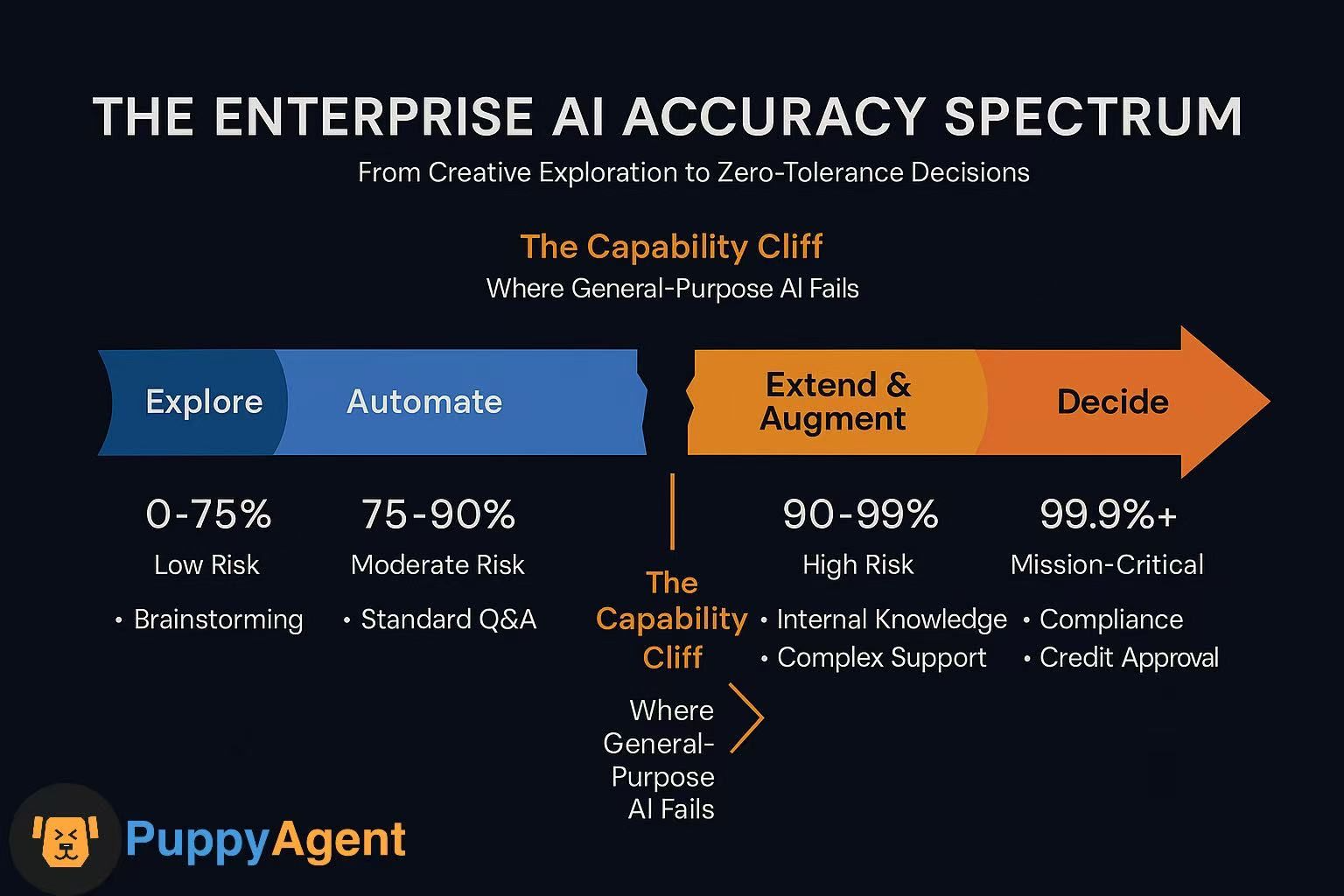

Para gerenciar sistematicamente riscos impulsionados por IA e desbloquear valor comercial, líderes primeiro precisam de uma estrutura clara para avaliar os requisitos de precisão de diferentes casos de uso. A estrutura "AI Use Case Accuracy Tiers" abaixo categoriza aplicações de IA baseadas em sua precisão necessária e tolerância a riscos.

| Nível de Precisão | Precisão Necessária | Casos de Uso Típicos | Riscos Potenciais |

|---|---|---|---|

| Nível 1: Tolerância Zero | 99,9%+ | Diagnósticos médicos, conformidade legal, aprovação de crédito financeiro, AML | Riscos catastróficos legais, financeiros ou de segurança |

| Nível 2: Alto Risco | 90-99% | Suporte ao cliente complexo, gerenciamento de conhecimento interno, avaliação de risco de subscrição | Perda significativa de negócio, rotatividade de clientes, questões de conformidade |

| Nível 3: Confiabilidade Contextual | 75-90% | Chatbots de atendimento ao cliente padrão, análise de tendências de mercado, sistemas de Q&A | Experiência ruim do usuário, ineficiência operacional |

| Nível 4: Criativo & Exploratório | 0-75% | Geração de conteúdo, brainstorming, assistentes pessoais | Saída de baixa qualidade ou inutilizável |

O Custo Comercial da Imprecisão de IA: Quantificando o Risco

Imprecisão de IA não é mais apenas uma questão técnica; é um risco sistêmico maior que demanda supervisão executiva. Para entender seu impacto comercial profundo, devemos quantificar os custos.

Impacto Financeiro

- $67,4 bilhões - Perdas globais atribuídas a "alucinações" de IA em 2024 (estudo AllAboutAI 2025)

- Quase 50% dos usuários empresariais de IA admitiram tomar decisões comerciais significativas baseadas em conteúdo potencialmente impreciso gerado por IA

Custos Operacionais

- 22% queda média na eficiência da equipe devido à verificação manual de saídas de IA (Boston Consulting Group 2025)

- $14.200 por funcionário anualmente - Custo de esforços de mitigação de alucinação (Forrester Research)

Escolha Tecnológica Estratégica: RAG vs. Ajuste Fino

Para habilitar casos de uso de Nível 1 e Nível 2, um Agente de IA deve ter uma fonte de conhecimento inquestionavelmente confiável. Geração Aumentada por Recuperação (RAG) e Ajuste Fino são os dois métodos primários para alcançar isso.

| Fator de Decisão | Geração Aumentada por Recuperação (RAG) | Ajuste Fino |

|---|---|---|

| Método de Personalização | Injeta prompts com documentos externos recuperados | Atualiza pesos do modelo para internalizar conhecimento |

| Atualização de Dados | Tempo real; adapta-se instantaneamente a novas informações | Estático; conhecimento congelado no tempo de treinamento |

| Velocidade de Implantação | Extremamente rápida (horas a dias) | Lenta (semanas a meses) |

| Explicabilidade/Auditabilidade | Alta; pode citar fontes e fornecer trilha de evidências | Baixa; opera como uma "caixa preta" |

| Segurança de Dados | Alta; dados sensíveis permanecem isolados | Menor; vetores potenciais de vazamento de dados |

| Impacto Comercial | Tempo rápido para valor, ideal para pilotos rápidos | Alto investimento inicial, longos ciclos de implantação |

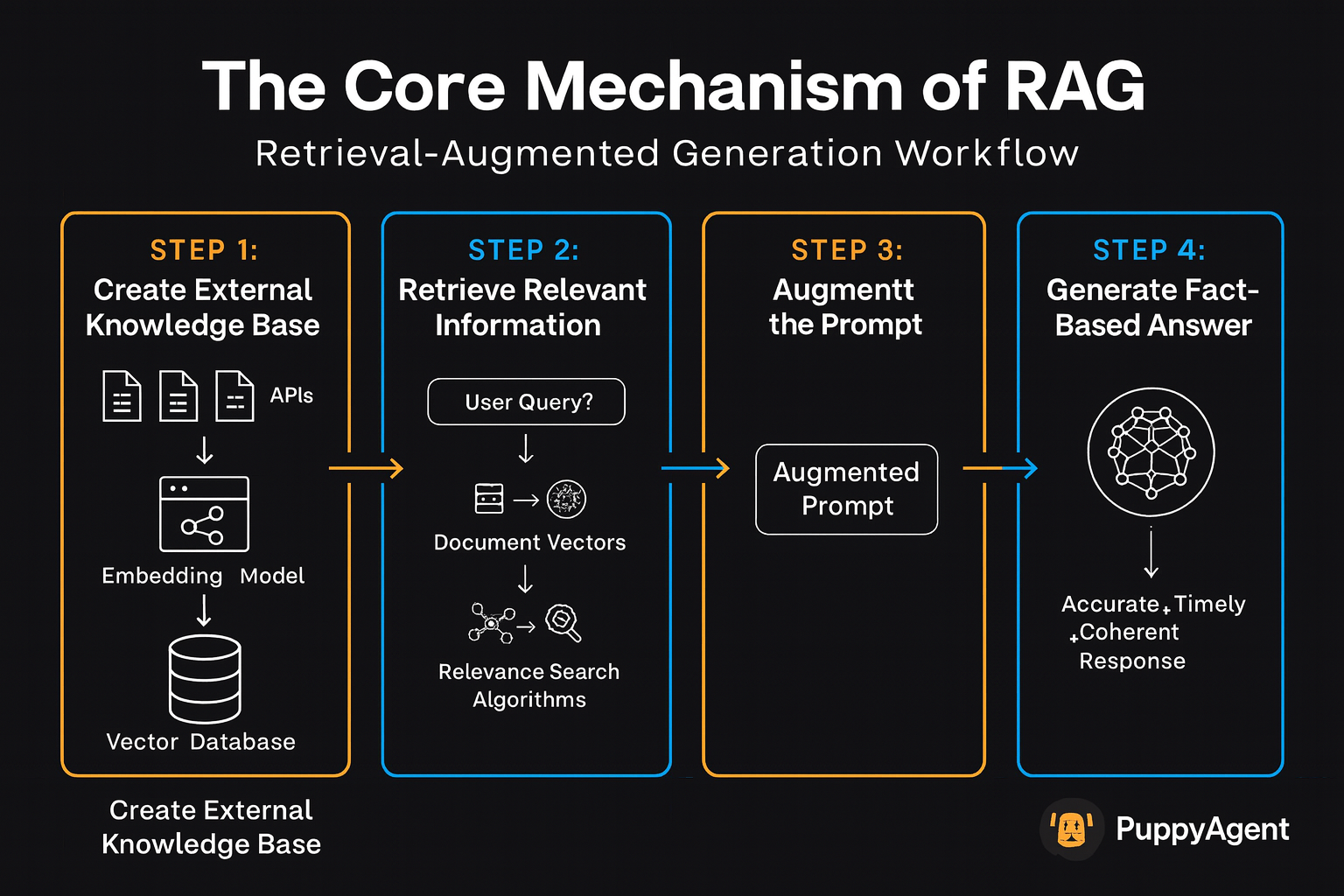

O Mecanismo Central do RAG

Um sistema RAG combina poderosamente recuperação de informações com geração. Seu fluxo de trabalho tipicamente segue estes passos:

Passos do Fluxo de Trabalho RAG:

- Criar uma Base de Conhecimento Externa - Converter dados proprietários em vetores pesquisáveis

- Recuperar Informações Relevantes - Corresponder consultas de usuários contra base de conhecimento

- Aumentar o Prompt - Integrar informações recuperadas com consulta original

- Gerar uma Resposta Baseada em Fatos - LLM produz respostas precisas e oportunas

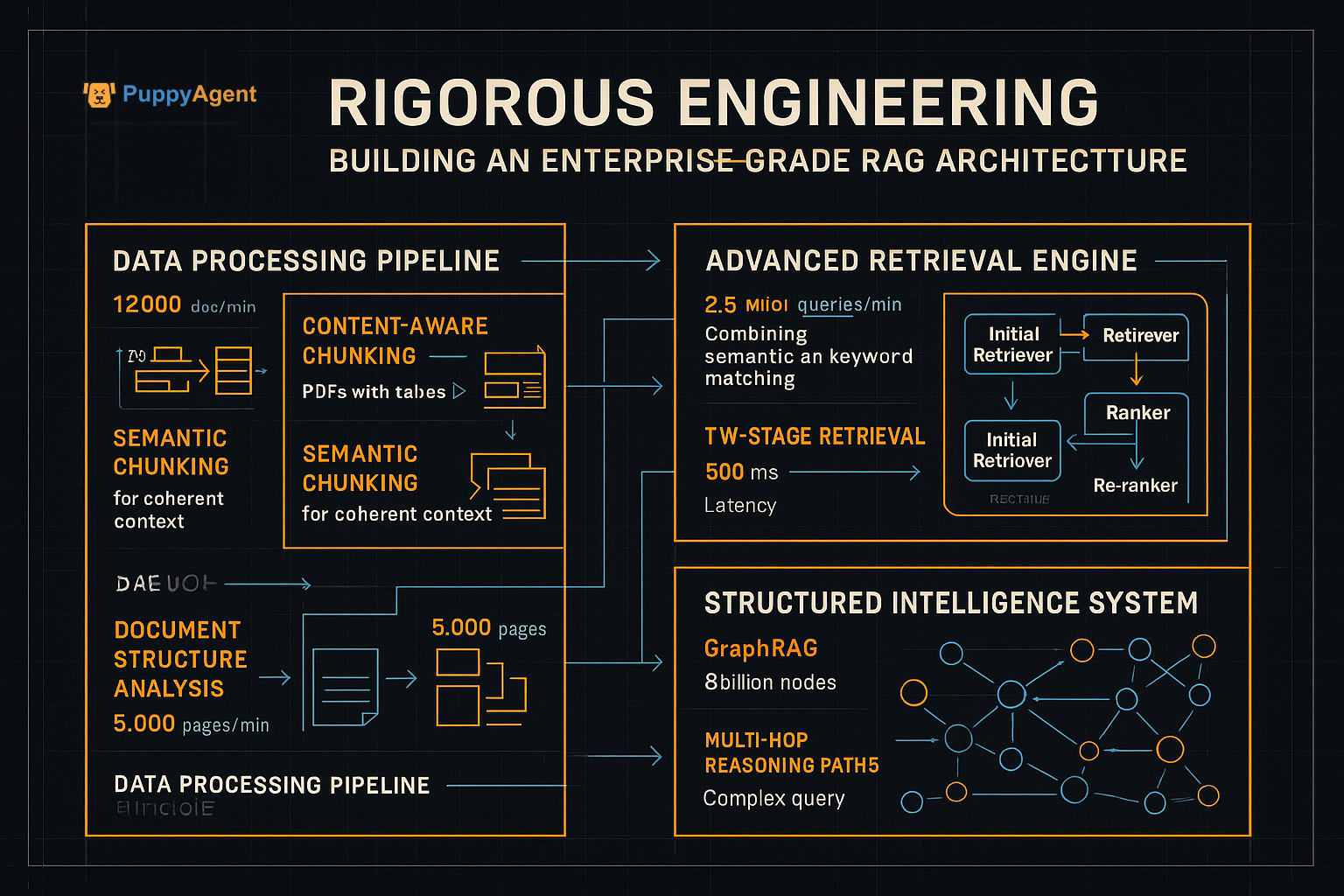

Construindo Arquitetura RAG de Nível Empresarial

Num contexto empresarial, o sucesso é determinado pela engenharia rigorosa de pipelines de dados e recuperação.

Considerações de Engenharia Chave:

Fundação Centrada em Dados

- 80% do sucesso RAG depende da qualidade dos dados

- Chunking consciente de conteúdo para documentos complexos

- Chunking semântico para preservação de contexto coerente

Estratégias de Recuperação Avançadas

- Busca híbrida combinando abordagens de palavra-chave e vetoriais

- Recuperação de dois estágios com otimização de re-ranker

- GraphRAG para dados estruturados e raciocínio multi-hop

Valor Comercial Quantificável: Estudos de Caso do Mundo Real

Eficiência Operacional & Produtividade

- Fabricante Fortune 500: Reduziu tempos de resposta de atendimento ao cliente de 5+ minutos para 10-30 segundos

- 90% classificação 5 estrelas de representantes de serviço

- Montadora Tier 1: 25% de aumento na taxa de correção na primeira vez para técnicos

Sucesso em Indústria Regulamentada

- Precina Health: Pacientes diabéticos reduziram níveis A1c em 1% por mês (12x mais rápido que cuidado padrão)

- Implantação de IA médica em conformidade com HIPAA

Gerenciamento de Conhecimento

- Bell telecommunications: Garantiu acesso à política mais recente para funcionários

- LinkedIn: 28,6% de redução no tempo médio de resolução de problemas

Puppyone: Plataforma de Conhecimento Empresarial para Agentes de IA

Puppyone é projetado especificamente para construir pipelines RAG de nível empresarial, abstraindo desafios de engenharia complexos.

Proposições de Valor Central:

Prototipagem Rápida

- Interface intuitiva para preparação de dados

- Resolve complexidade "construa-você-mesmo"

Implantação Flexível

- Suporta chatbots, APIs e widgets de website

- Integração perfeita de arquitetura de TI

Tecnologia Avançada

- Técnicas RAG de ponta integradas

- Lida com desafios de casos de uso avançados

Segurança & Conformidade

- Segurança de nível empresarial

- Trilha de evidências transparente para auditorias

Conclusão: Preenchendo a Lacuna Probabilidade-Certeza

Existe um abismo vasto entre a natureza probabilística de LLMs de propósito geral e as necessidades determinísticas de indústrias de alto risco. RAG preenche este abismo fornecendo LLMs com fontes verificáveis e externas de verdade.

O valor futuro dos Agentes de IA será determinado por confiabilidade, verificabilidade e segurança - não apenas poder do modelo. Puppyone oferece às empresas uma plataforma confiável para construir sistemas de IA seguros e inteligentes que entregam valor comercial real enquanto gerenciam riscos críticos.