RAG:破解高风险场景下的AI智能体精度困境

2025年9月22日Ruixi @puppyone

尽管AI智能体在自动化企业工作流方面潜力巨大,但大型语言模型(LLM)的内在不稳定性在金融、法律和医疗等高度监管的行业中构成了重大风险。一个错误的输出就可能引发严重的法律或财务后果。

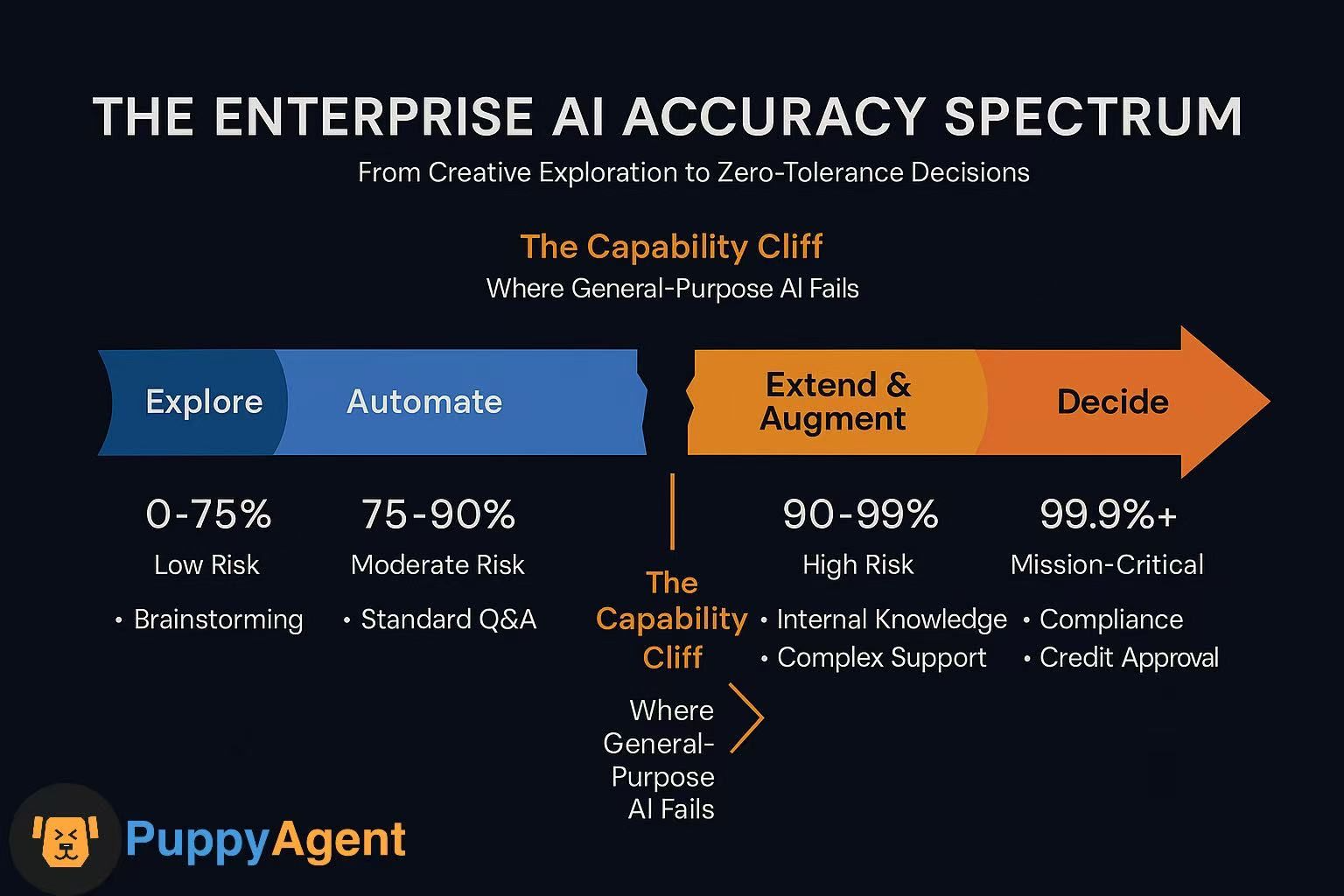

为了系统地管理AI驱动的风险并释放商业价值,领导者首先需要一个清晰的框架来评估不同用例的准确性要求。下面的“AI用例准确性等级”框架根据所需精度和风险容忍度对AI应用进行分类。

| 准确性等级 | 要求准确性 | 典型用例 | 潜在风险 |

|---|---|---|---|

| 等级一:零容忍 | 99.9%+ | 医疗诊断、法律合规、金融信贷审批、反洗钱 | 灾难性的法律、财务或安全风险 |

| 等级二:高风险 | 90-99% | 复杂客户支持、内部知识管理、承保风险评估 | 重大业务损失、客户流失、合规问题 |

| 等级三:上下文可靠 | 75-90% | 标准客服聊天机器人、市场趋势分析、问答系统 | 用户体验差、运营效率低下 |

| 等级四:创意与探索 | 0-75% | 内容生成、头脑风暴、个人助理 | 输出质量低劣或无法使用 |

AI不准确性的商业成本:量化风险

AI的不准确性已不再仅仅是一个技术问题;它是一个需要高层管理者监督的重大系统性风险。要理解其深远的商业影响,我们必须量化其成本。

财务影响

- 674亿美元 - 2024年全球因AI“幻觉”造成的损失(AllAboutAI 2025年研究)

- 近50% 的企业AI用户承认曾基于可能不准确的AI生成内容做出重大商业决策

运营成本

- 因手动验证AI输出,团队效率平均下降22%(波士顿咨询集团2025年)

- 每位员工每年14,200美元 - 幻觉缓解工作的成本(Forrester Research)

战略性技术选择:RAG vs. 微调

要实现第一级和第二级的用例,AI智能体必须拥有一个绝对可靠的知识来源。检索增强生成(RAG)和微调是实现这一目标的两种主要方法。

| 决策因素 | 检索增强生成(RAG) | 微调 |

|---|---|---|

| 定制方法 | 通过检索到的外部文档注入提示 | 更新模型权重以内部化知识 |

| 数据新鲜度 | 实时;即时适应新信息 | 静态;知识在训练时被冻结 |

| 部署速度 | 极快(数小时至数天) | 慢(数周至数月) |

| 可解释性/可审计性 | 高;可引用来源并提供证据链 | 低;作为“黑匣子”运行 |

| 数据安全 | 高;敏感数据保持隔离 | 较低;潜在的数据泄露途径 |

| 商业影响 | 价值实现时间短,适合快速试点 | 前期投资高,部署周期长 |

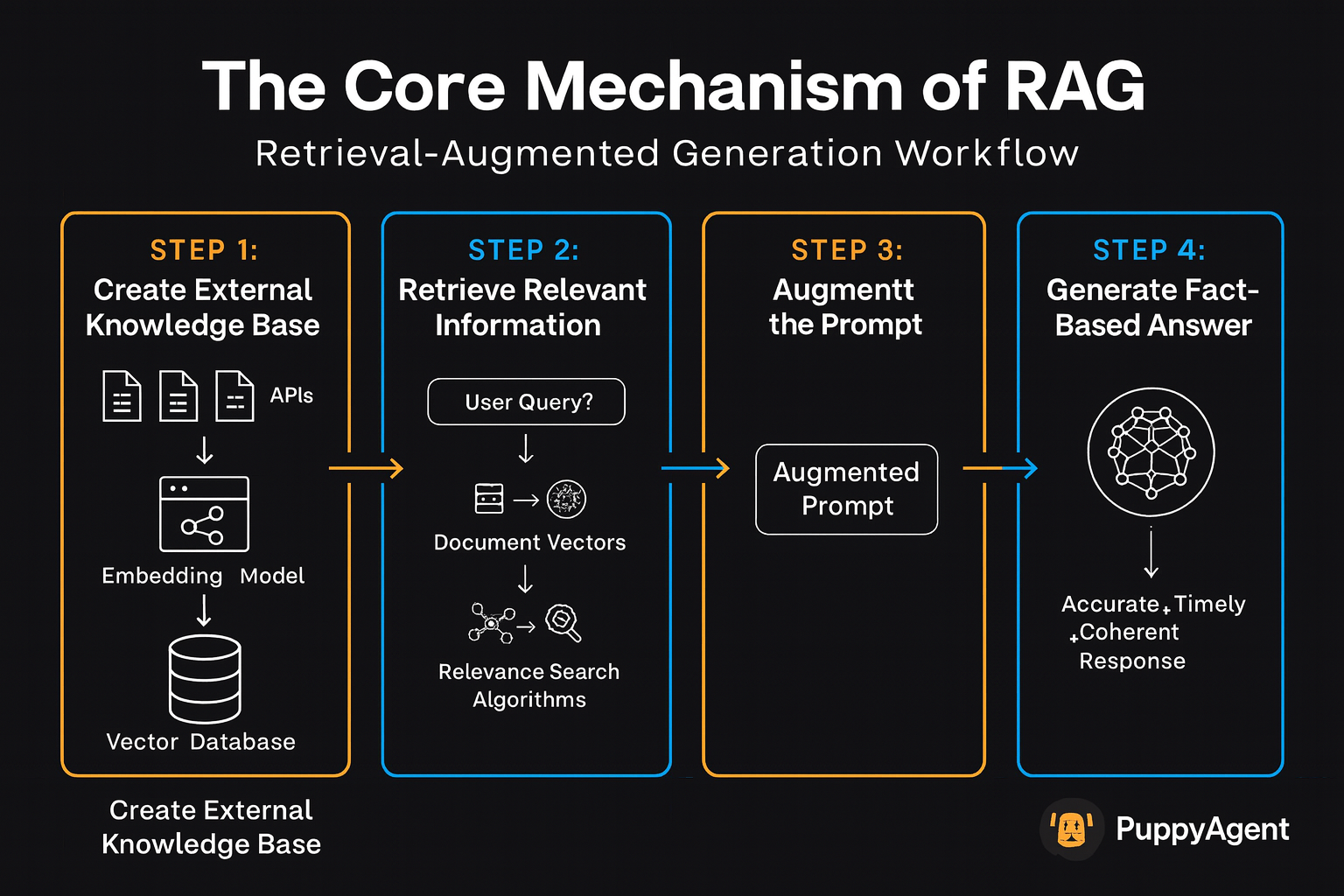

RAG的核心机制

RAG系统将信息检索与生成强大地结合在一起。其工作流程通常遵循以下步骤:

RAG工作流程步骤:

- 创建外部知识库 - 将专有数据转换为可搜索的向量

- 检索相关信息 - 将用户查询与知识库进行匹配

- 增强提示 - 将检索到的信息与原始查询集成

- 生成基于事实的答案 - LLM生成准确、及时的响应

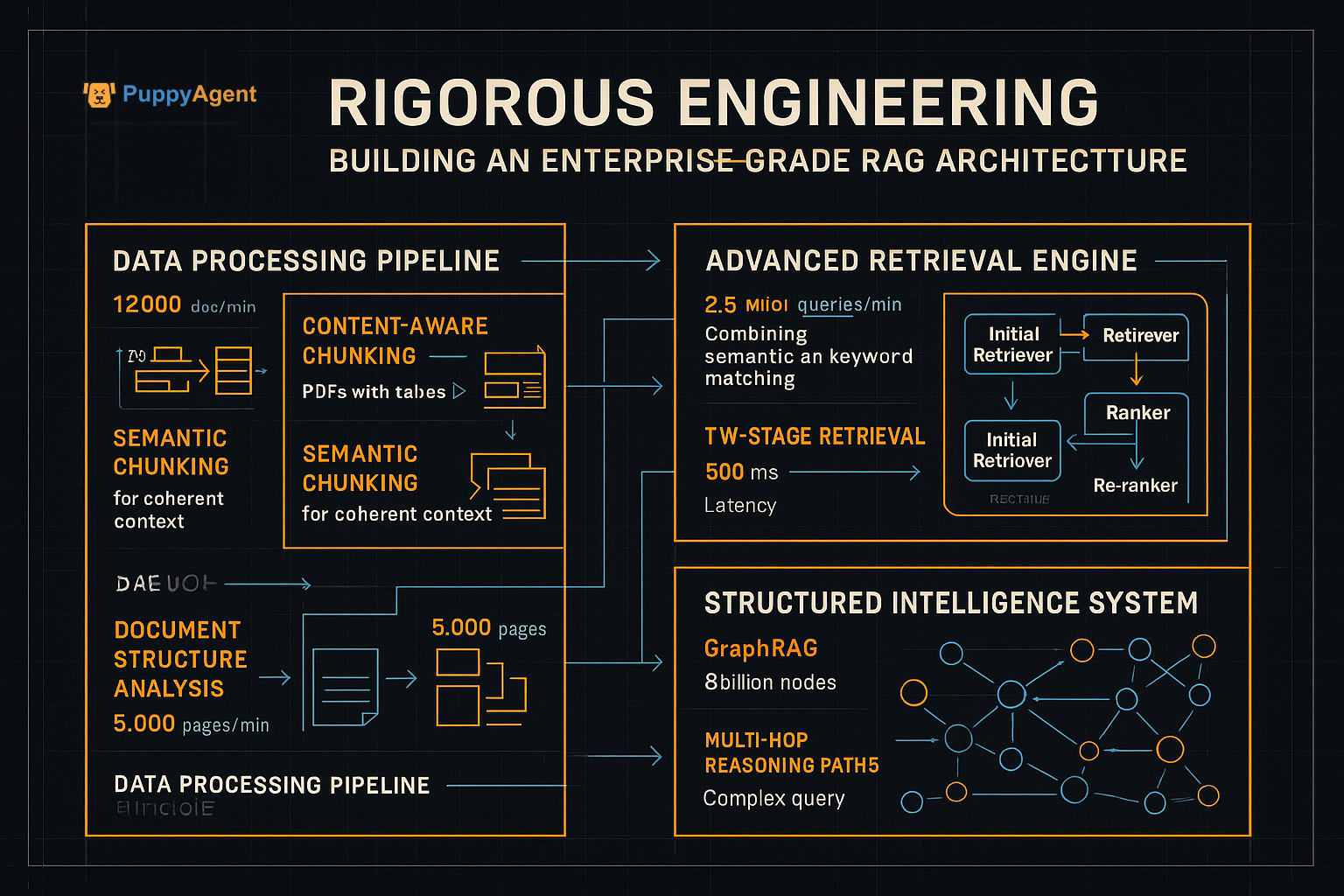

构建企业级RAG架构

在企业环境中,成功取决于对数据和检索管道的严格工程设计。

关键工程考量:

以数据为中心的基础

- 80%的RAG成功取决于数据质量

- 内容感知的切块,适用于复杂文档

- 语义切块,用于连贯的上下文保留

先进的检索策略

- 混合搜索,结合关键字和向量方法

- 两阶段检索,带重新排序器优化

- GraphRAG,用于结构化数据和多跳推理

可量化的商业价值:真实案例研究

运营效率与生产力

- 财富500强制造商:将客户服务响应时间从5分钟以上缩短至10-30秒

- 服务代表给予90%的五星好评

- 一级汽车制造商:技术人员首次修复率提高25%

受监管行业的成功案例

- Precina Health:糖尿病患者的A1c水平每月降低1%(比标准护理快12倍)

- 符合HIPAA的医疗AI部署

知识管理

- 贝尔电信:确保员工能访问最新的政策

- 领英:平均问题解决时间减少28.6%

Puppyone:面向AI智能体的企业知识平台

Puppyone专为构建企业级RAG管道而设计,抽象了复杂的工程挑战。

核心价值主张:

快速原型设计

- 直观的数据准备界面

- 解决了“自己动手”的复杂性

灵活部署

- 支持聊天机器人、API和网站小部件

- 无缝集成IT架构

先进技术

- 内置尖端的RAG技术

- 处理高级用例挑战

安全与合规

- 企业级安全

- 透明的审计证据链

结论:弥合概率与确定性之间的差距

通用LLM的概率性与高风险行业的确定性需求之间存在巨大鸿沟。RAG通过为LLM提供可验证的外部真实来源,弥合了这一鸿沟。

AI智能体的未来价值将取决于可靠性、可验证性和安全性——而不仅仅是模型的强大功能。Puppyone为企业提供了一个值得信赖的平台,用于构建安全、智能的AI系统,在管理关键风险的同时,实现真正的商业价值。