90 % der KI-Agenten am 'doppelten Abgrund': Allgemeine Modelle scheitern an der Umsetzung, spezialisierte an der Akzeptanz

Bildquelle: puppyone

Bildquelle: puppyone

Der Gartner-Bericht 2025 besagt, dass 83 % der unternehmensweiten KI-Projekte die Erwartungen nicht erfüllen. Während die KI-Branche noch über die Vorzüge von "Generalisten" gegenüber "vertikalen Spezialisten" debattiert, zeichnet sich eine harte Realität ab: 90 % der Unternehmen für KI-Agenten stecken in einer Zwickmühle aus "unzureichenden allgemeinen Fähigkeiten + Mangel an vertikalen Daten". In diesem Dilemma ohne richtige Antwort steuern 90 % der Agenten-Projekte leise auf ein Scheitern zu, während die Überlebenden nach neuen Wegen suchen, um am Rande des Abgrunds am Leben zu bleiben.

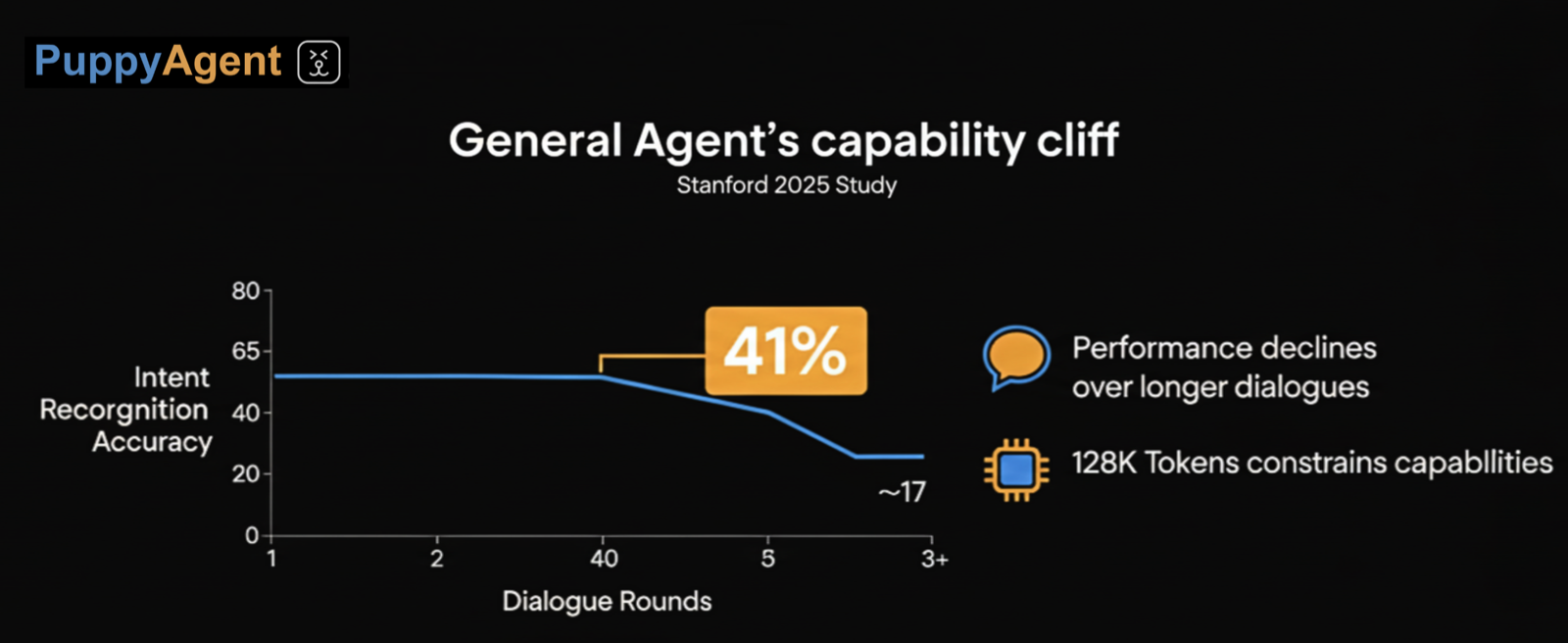

Vorderer Abgrund: Der "Fähigkeitsabgrund" der allgemeinen Agenten

Absichtsverständnis und Befolgung von Anweisungen sind zwei entscheidende Grundfähigkeiten für einen Agenten. Herkömmliche grundlegende große Modelle können den Anforderungen komplexer Aufgaben nicht mehr gerecht werden. Agenten erfordern vielfältige Arbeitsabläufe, Systeme und Steuerungen... die die Basismodelle in implementierbare Systeme einkapseln.

Die Vision eines allgemeinen Agenten ist verlockend – eine einzige intelligente Entität, die in der Lage ist, Probleme in verschiedenen Bereichen zu lösen.

Bildquelle: puppyone

Bildquelle: puppyone

Wenn jedoch die meisten Unternehmen versuchen, sogenannte allgemeine KI-Agenten in professionellen Szenarien anzuwenden, stoßen sie häufig auf einen "Fähigkeitsabgrund". Ein Test der Stanford University aus dem Jahr 2025 enthüllte eine schockierende Tatsache: Wenn die Anweisungen der Benutzer drei Dialogrunden überschreiten, sinkt die Genauigkeit der Absichtserkennung allgemeiner Agenten auf 41 %. Obwohl Modelle wie Claude den System-Prompt auf 128K Token erweitert haben, verwechseln diese Agenten in Szenarien mit mehreren Rollen immer noch häufig die wahren Bedürfnisse der Benutzer und beurteilen einfache Anfragen fälschlicherweise als komplexe Entscheidungen.

Gefährlicher ist die Falle der hochskalierten Halluzinationen.

In professionellen Szenarien wie der Finanzrisikokontrolle liegt die Fehlerrate von Inhalten, die von allgemeinen Agenten generiert werden, bei bis zu 52 %, und diese Fehler werden oft in einem professionellen Ton präsentiert, z. B. durch das Erfinden von regulatorischen Bestimmungen oder das Erfinden von statistischen Daten. Eine Bank investierte einmal stark in die Entwicklung eines allgemeinen Risikokontrollagenten, nur um festzustellen, dass dessen Fehlerrate bei der Bearbeitung zusammengesetzter Entscheidungen, die "historisches Kundenverhalten + Marktschwankungen + Richtlinienänderungen" umfassten, 65 % überstieg, was das Unternehmen zwang, das 3,2-fache an Personal für die Überprüfung zu investieren. Ein MIT-Experiment zur bereichsübergreifenden Migration bewies, dass, wenn ein im medizinischen Bereich trainierter Agent in ein juristisches Szenario versetzt wurde, die Erfolgsquote der Aufgaben von 78 % auf 32 % sank. Das Kernproblem liegt in der Nicht-Generalisierbarkeit des Handlungsraums – wenn die Tool-Nutzungsschnittstelle von einer medizinischen API auf eine finanzielle API umschaltet, kann der Agent seinen Handlungsraum nicht anpassungsfähig anpassen.

Viele Unternehmen verfallen einem gefährlichen Trugschluss: Sie setzen "in der Lage sein, eine Demo auszuführen" mit "geschäftlichen Wert haben" gleich.

Bildquelle: puppyone

Bildquelle: puppyone

Ein Automobilhersteller investierte einmal 20 Millionen in das Training eines "allgemeinen Kundendienstagenten", aber er scheiterte in realen Szenarien, weil er keine zusammengesetzten Entscheidungen mit "Reifentyp + Wetter + Fahrgewohnheiten" treffen konnte. Dies offenbart ein Schlüsselparadoxon: Je mehr ein allgemeiner Agent "Allmacht" anstrebt, desto geringer wird seine Zuverlässigkeit in vertikalen Szenarien.

"Wir trainieren keine intelligenten Agenten; wir kleiden Halluzinationen in professionelle Kleidung." Das Dilemma allgemeiner Agenten ist nicht, dass sie nicht alles können, sondern dass sie in professionellen Szenarien nicht einmal grundlegende Aktionen zuverlässig ausführen können.

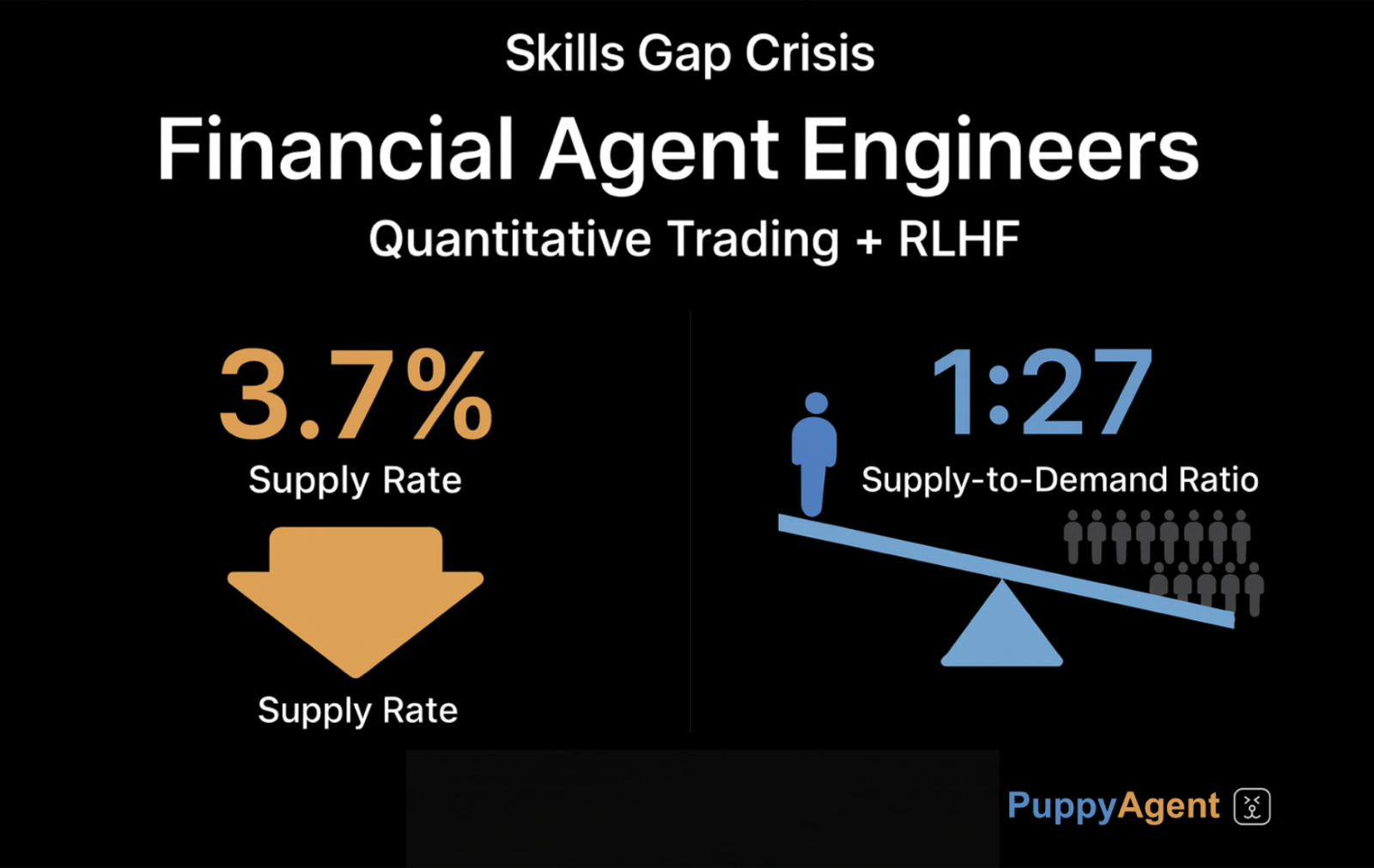

Hinterer Abgrund: Der "Ressourcenabgrund" der vertikalen Agenten

Wenn sich Unternehmen für einen Durchbruch an vertikale Agenten wenden, stellen sie fest, dass sie in einen weiteren "Ressourcenabgrund" stürzen.

Kern-Branchendaten sind wie ein auf einer Insel verschlossener Schatz: Diagnosedaten von erstklassigen Krankenhäusern, Protokolle der Bankrisikokontrolle und andere wichtige Vermögenswerte sind für 91 % der Unternehmen aufgrund von Compliance-Barrieren unzugänglich. Was noch schwerwiegender ist, ist die Falle der Datenqualität. Ein industrielles KI-Team verbrachte acht Monate damit, Daten über Geräteausfälle zu erhalten, aber 67 % davon wurden aufgrund inkonsistenter Kennzeichnungsstandards für ungültig erklärt – vertikale Daten erfordern Branchen-Know-how, um korrekt verwendet zu werden. Reale Fälle zeigen, dass die Kosten für ein medizinisches KI-Unternehmen, um 100.000 konforme und gekennzeichnete Datenpunkte zu erhalten, von 830.000 Yuan im Jahr 2022 auf 4,12 Millionen Yuan im Jahr 2024 gestiegen sind, eine erstaunliche Steigerung von 400 %.

Bildquelle: puppyone

Bildquelle: puppyone

Noch knapper als Daten sind die hybriden Talente, die die Lücke zwischen Technologie und Industrie schließen können. Bei der Entwicklung von Finanzagenten sind Ingenieure, die sowohl die quantitative Handelslogik als auch die Abstimmung von RLHF (Reinforcement Learning from Human Feedback) beherrschen, Mangelware, mit einer Marktverfügbarkeit von weniger als 3,7 % der Nachfrage, was zu einem erstaunlichen Verhältnis von Angebot zu Nachfrage von 1:27 führt. Die Kommunikationsstörung zwischen Branchenexperten und KI-Ingenieuren führt oft zu katastrophalen Ergebnissen: Branchenexperten produzieren vage, auf Erfahrung basierende "Regelfragmente", die KI-Ingenieure dann in "fehlerhafte Wissensgraphen" zwingen, was dazu führt, dass die endgültigen Agenten erheblich vom Kern des Geschäfts abweichen. Ein Fertigungskunde forderte die Entwicklung eines "Agenten zur Vorhersage von Geräteausfällen", aber die Branchenexperten waren nicht in der Lage, die "spektralen Eigenschaften von Lagergeräuschen" in technischen Begriffen zu beschreiben, was zu einem Modelltraining führte, das die tatsächlichen Anforderungen völlig verfehlte.

Das Dilemma vertikaler Agenten besteht nicht nur darin, keine Daten erhalten zu können, sondern auch darin, die Daten nicht korrekt verstehen oder verwenden zu können, selbst wenn sie erhalten werden.

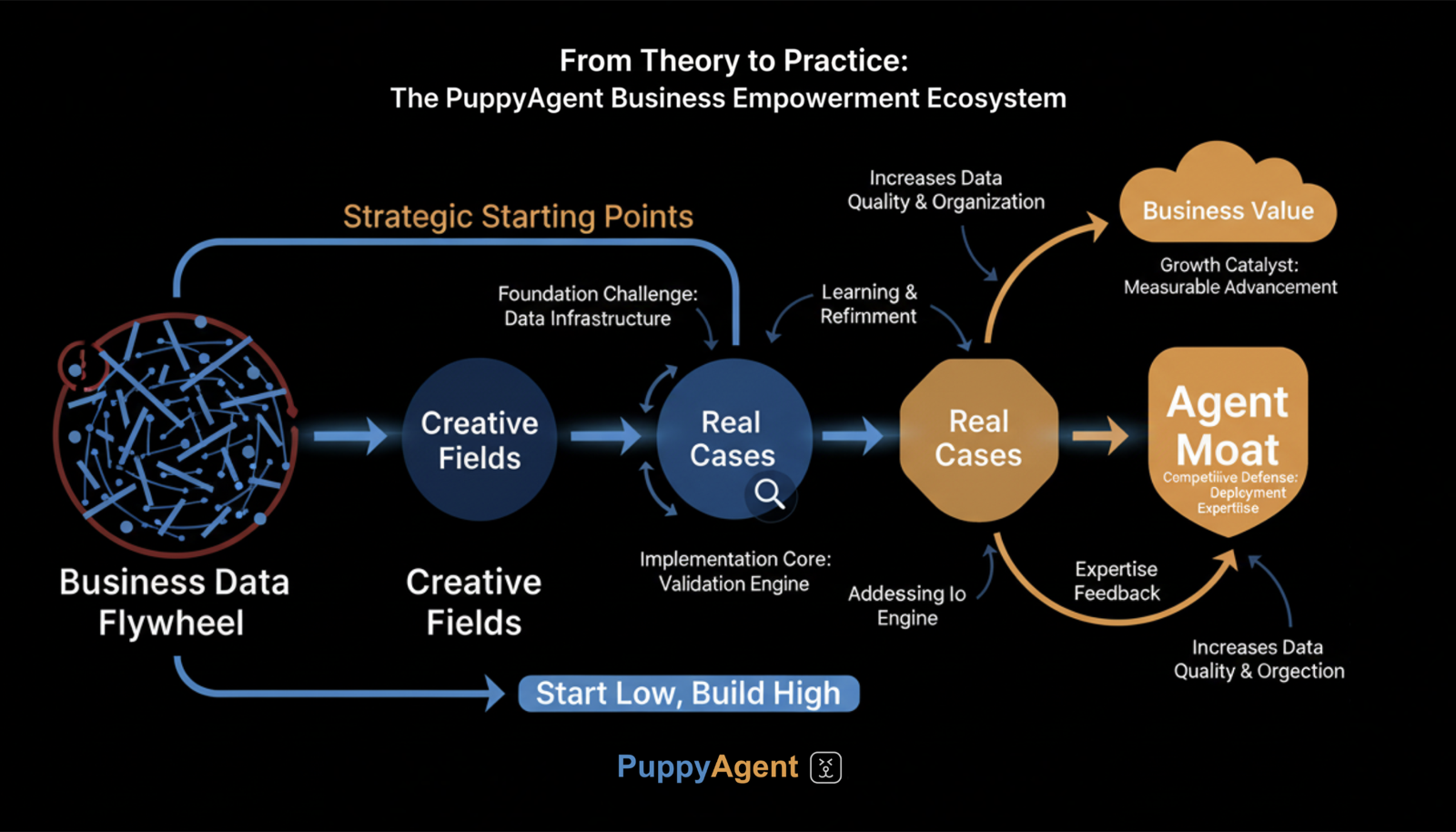

Überlebensstrategie: Die Drei-Schritte-Durchbruchmethode zur Überbrückung des doppelten Abgrunds

Derzeit basieren die meisten Basismodelle auf der Destillation von Modellreihen wie GPT und Claude. Die Mehrheit der Daten wurde nicht für ihre eigenen Geschäftsszenarien und regionalen/nationalen Gegebenheiten gekennzeichnet. Das bloße Erstellen von Arbeitsabläufen und das Hinzufügen von RAG (Retrieval-Augmented Generation) und anderen Mitteln kann keine wirklich durchgängigen Implementierungsfähigkeiten erreichen.

Viele Unternehmen oder Organisationen haben nicht einmal ihre eigenen Geschäftsdaten-Schwungräder sortiert, geschweige denn das Geschäftswachstum mit Agenten vorangetrieben.

Bildquelle: Pexels

Bildquelle: Pexels

In dieser unangenehmen Situation ist es möglicherweise wichtiger, Agenten nutzen zu können, um wirklich mehr geschäftswertschöpfende Szenarien zu schaffen. Wenn keine hohe Genauigkeit verfügbar ist, kann man mit kreativen Bereichen beginnen, die eine geringere Genauigkeit erfordern; wenn ein Mangel an Daten besteht, kann man Geschäftseinstiegspunkte mit mehr Open-Source-Daten erkunden. Das Grundlegende ist, mehr reale Fälle zu erhalten, um im tatsächlichen Kampf einen eigenen Agenten-Vorsprung aufzubauen.

Wenn auch Sie die komplizierte Arbeit zur Hand werfen möchten, klicken Sie bitte auf "Erste Schritte" an der Seite, um die Geschäftsmöglichkeiten zu erkunden, die puppyone bietet.

puppyone hat schon immer die Nutzung von dynamischem interaktivem RAG und Agenten erforscht, um echtes Geschäftswachstum in Arbeitsabläufen zu bedienen. Wir hoffen, die Benutzer mit jedem durchgängigen Fall zu inspirieren, anstatt mit unserer Generalisierbarkeit zu prahlen oder uns auf ein einziges vertikales Szenario zu beschränken. Wir haben jetzt zahlreiche Fälle in Bereichen wie Kundenservice, Wohnungsvermietung, Rechtsangelegenheiten und Dokumentenmanagement implementiert. Sie können auf die Fallvideos ansehen klicken.

Fazit

Exzellente Fälle und Unternehmen haben alle eine gemeinsame Eigenschaft: Sie konzentrieren sich nicht mehr darauf, den "perfekten Agenten" zu schaffen, sondern darauf, ein "Mensch-Maschine-kollaboratives Entscheidungssystem" aufzubauen, Sicherheitsgeländer an Schlüsselknoten einzurichten und die Effizienz von Agenten in Routineszenarien freizusetzen.

Für Unternehmen, die am Rande des Abgrunds schwanken, besteht die Hauptaufgabe darin, sich der Realität zu stellen: Allgemeine Agenten können nicht alles, und vertikale Agenten können Kernressourcen nicht fest im Griff haben. Der wahre Ausweg liegt im systematischen Denken – der organischen Kombination von Branchenwissensdestillation, Verbesserung kleiner Daten und Mensch-Maschine-kollaborativer Überprüfung, um eine implementierbare "Drei-Schritte-Durchbruchmethode" zu bilden.

Bildquelle: puppyone

Bildquelle: puppyone

Wir können Manus/Genspark wiederholt fragen, wenn eines Tages OpenAI und Google wirklich allgemeine Agenten erreichen, wo wird Ihre Wettbewerbsfähigkeit liegen? Wir können auch OpenAI und Google fragen, was die wirklichen Schwierigkeiten bei der Skalierung von Szenarien und der Generalisierung von Arbeitsabläufen sind. Im Wesentlichen ist dies ein Drahtseil, das zwischen Klippen hängt.

Ist Ihr Unternehmen bereit, diesen Drahtseilakt zu gehen?