90% de Agentes IA en el 'acantilado doble': entre la generalización ineficaz y la especialización limitada

Fuente de la Imagen: puppyone

Fuente de la Imagen: puppyone

El reporte Gartner 2025 establece que el 83% de los proyectos corporativos de IA fallan en cumplir las expectativas. Mientras la industria de IA aún debate los méritos de "generalistas" versus "especialistas verticales", una realidad dura está emergiendo: el 90% de las compañías de Agentes IA están atrapadas en un doble vínculo de "capacidades generales insuficientes + falta de datos verticales". En este dilema sin respuesta correcta, el 90% de los proyectos de Agentes se dirigen silenciosamente hacia el fracaso, mientras los supervivientes buscan nuevas formas de mantenerse vivos al borde del acantilado.

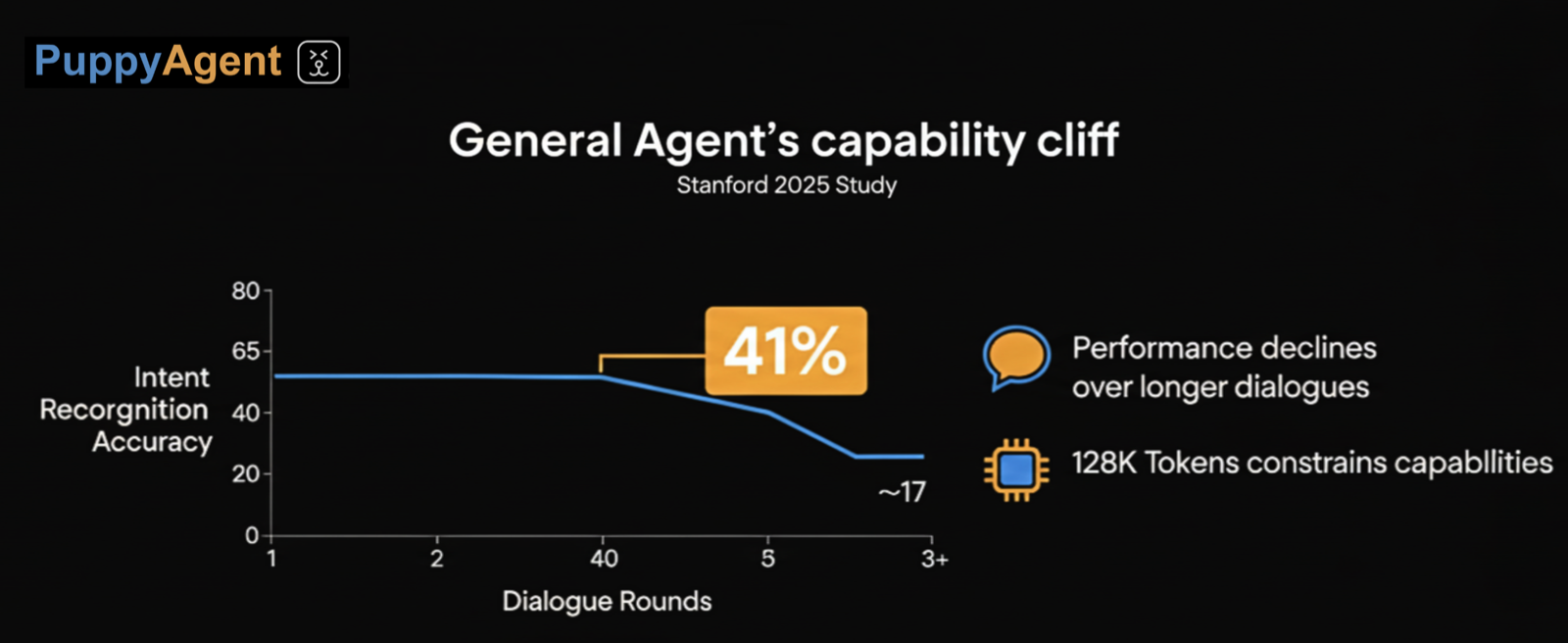

Acantilado Frontal: El "Acantilado de Capacidades" de los Agentes Generales

La comprensión de intenciones y el seguimiento de instrucciones son dos capacidades básicas cruciales para un Agente. Los modelos de lenguaje grandes fundacionales tradicionales ya no pueden satisfacer las demandas de tareas complejas. Los Agentes requieren flujos de trabajo diversos, sistemas y controles... encapsulando los modelos base en sistemas implementables.

La visión de un Agente general es atractiva—una sola entidad inteligente capaz de resolver problemas en varios campos.

Fuente de la Imagen: puppyone

Fuente de la Imagen: puppyone

Sin embargo, cuando la mayoría de las compañías intentan aplicar los llamados Agentes IA generales a escenarios profesionales, frecuentemente encuentran un "acantilado de capacidades". Una prueba de 2025 de la Universidad de Stanford reveló un hecho impactante: cuando las instrucciones del usuario exceden tres rondas de diálogo, la precisión de reconocimiento de intenciones de los Agentes generales se desploma al 41%. Aunque modelos como Claude han expandido el prompt del sistema a 128K tokens, en escenarios multi-rol, estos Agentes aún frecuentemente confunden las verdaderas necesidades de los usuarios, malinterpretando consultas simples como decisiones complejas.

Lo que es más peligroso es la trampa de las alucinaciones escaladas.

En escenarios profesionales como el control de riesgo financiero, la tasa de error del contenido generado por Agentes generales es tan alta como 52%, y estos errores a menudo se presentan en un tono profesional, como fabricar disposiciones regulatorias o inventar datos estadísticos. Un banco una vez invirtió fuertemente en desarrollar un Agente general de control de riesgo, solo para descubrir que su tasa de error excedió el 65% al manejar decisiones compuestas que involucraban "comportamiento histórico del cliente + fluctuaciones del mercado + cambios de políticas", obligando a la compañía a invertir 3.2 veces la mano de obra para verificación. Un experimento del MIT sobre migración entre campos probó que cuando un Agente entrenado en el campo médico fue transferido a un escenario legal, la tasa de aprobación de tareas cayó del 78% al 32%. El problema central radica en la no-generalizabilidad del espacio de acción—cuando la interfaz de Uso de Herramientas cambia de una API médica a una API financiera, el Agente no puede ajustar adaptativamente su espacio de acción.

Muchas compañías están cayendo en una concepción errónea peligrosa: equiparar "poder ejecutar una demo" con "tener valor comercial".

Fuente de la Imagen: puppyone

Fuente de la Imagen: puppyone

Un fabricante de automóviles una vez invirtió 20 millones en entrenar un "Agente general de servicio al cliente", pero falló en escenarios reales porque no podía manejar decisiones compuestas que involucraban "tipo de neumático + clima + hábitos de conducción". Esto revela una paradoja clave: mientras más un Agente general persigue la "omnipotencia", menor se vuelve su confiabilidad en escenarios verticales.

"No estamos entrenando agentes inteligentes; estamos vistiendo alucinaciones con atuendo profesional". El dilema de los Agentes generales no es que no puedan hacer todo, sino que ni siquiera pueden realizar acciones básicas de manera confiable en escenarios profesionales.

Acantilado Trasero: El "Acantilado de Recursos" de los Agentes Verticales

Cuando las compañías recurren a Agentes verticales para un avance, se encuentran cayendo en otro "acantilado de recursos".

Los datos centrales de la industria son como tesoros encerrados en una isla: datos de diagnóstico de hospitales de primer nivel, registros de control de riesgo bancario y otros activos clave son inaccesibles para el 91% de las compañías debido a barreras de cumplimiento. Lo que es más severo es la trampa de calidad de datos. Un equipo de IA industrial pasó ocho meses obteniendo datos de fallas de equipos, pero el 67% fue invalidado debido a estándares de etiquetado inconsistentes—los datos verticales requieren conocimiento de la industria para ser usados correctamente. Casos reales muestran que el costo para una compañía de IA médica de obtener 100,000 puntos de datos compatibles y etiquetados se ha disparado de 830,000 yuanes en 2022 a 4.12 millones de yuanes en 2024, un aumento asombroso del 400%.

Fuente de la Imagen: puppyone

Fuente de la Imagen: puppyone

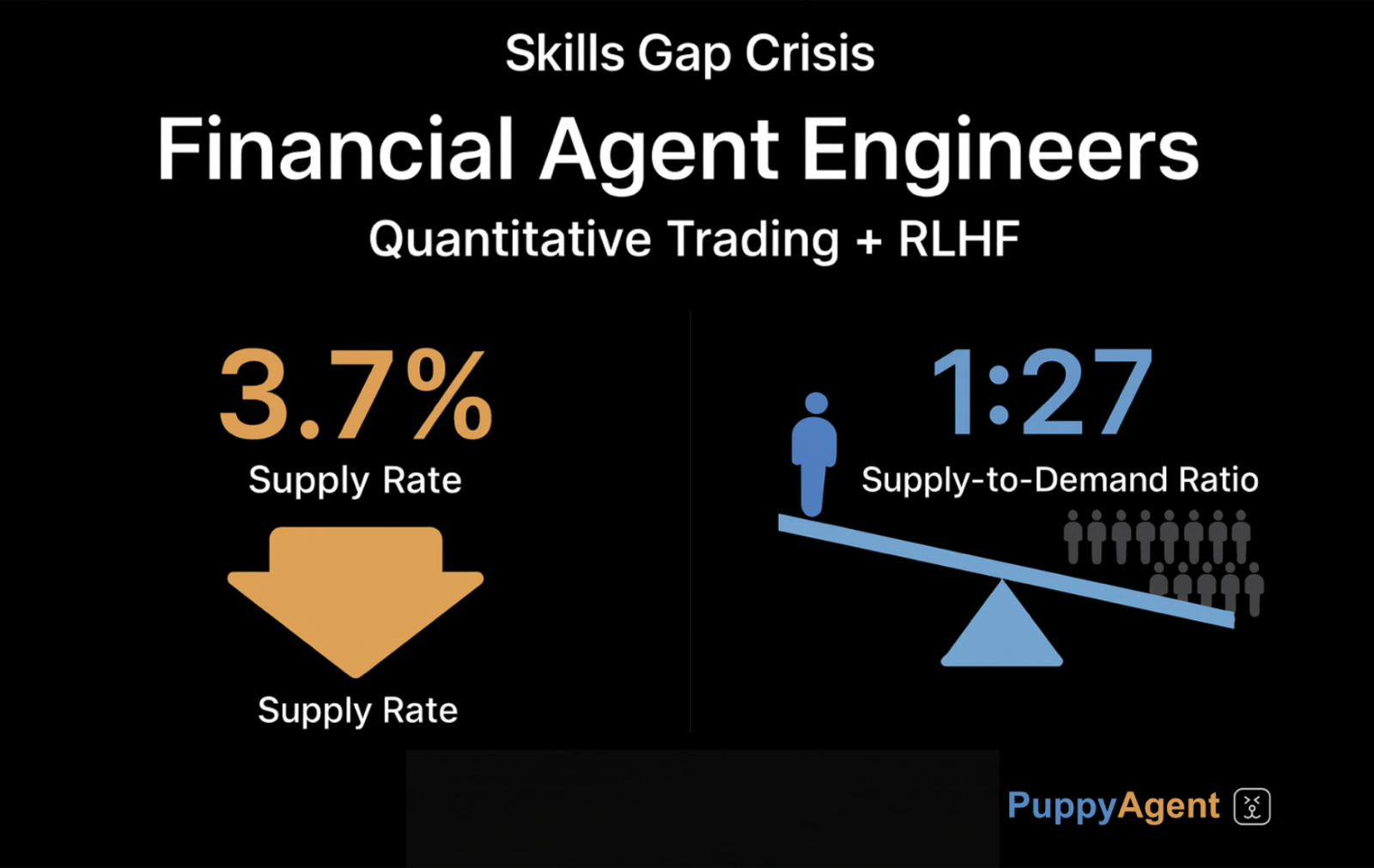

Aún más escasos que los datos son los talentos híbridos que pueden cerrar la brecha entre tecnología e industria. En el desarrollo de Agentes financieros, los ingenieros que pueden dominar tanto la lógica de trading cuantitativo como el ajuste RLHF (Aprendizaje por Refuerzo con Retroalimentación Humana) están en escasez, con una disponibilidad de mercado de menos del 3.7% de la demanda, resultando en una proporción asombrosa de oferta-demanda de 1:27. La ruptura de comunicación entre expertos de la industria e ingenieros de IA a menudo lleva a resultados desastrosos: los expertos de la industria producen "fragmentos de reglas" vagos basados en experiencia, que los ingenieros de IA luego fuerzan en "grafos de conocimiento erróneos", causando que los Agentes finales se desvíen significativamente de la esencia del negocio. Un cliente manufacturero solicitó el desarrollo de un "Agente de predicción de fallas de dispositivos", pero los expertos de la industria fueron incapaces de describir las "características espectrales del ruido de rodamientos" en términos técnicos, llevando a un entrenamiento de modelo que completamente perdió los requisitos reales.

El dilema de los Agentes verticales no es solo sobre no poder obtener datos, sino también sobre no poder entender o usar los datos correctamente incluso cuando se obtienen.

Estrategia de Supervivencia: El Método de Avance de Tres Pasos para Superar el Doble Acantilado

En la actualidad, la mayoría de los modelos base dependen de destilación de series de modelos como GPT y Claude. La mayoría de los datos no han sido etiquetados para sus propios escenarios de negocio y condiciones regionales/nacionales. Simplemente construir flujos de trabajo y agregar RAG (Generación Aumentada por Recuperación) y otros medios no puede lograr capacidades de implementación verdaderamente de extremo a extremo.

Muchas compañías u organizaciones ni siquiera han ordenado sus propios volantes de datos de negocio, mucho menos impulsar el crecimiento empresarial con Agentes.

Fuente de la Imagen: pexels

Fuente de la Imagen: pexels

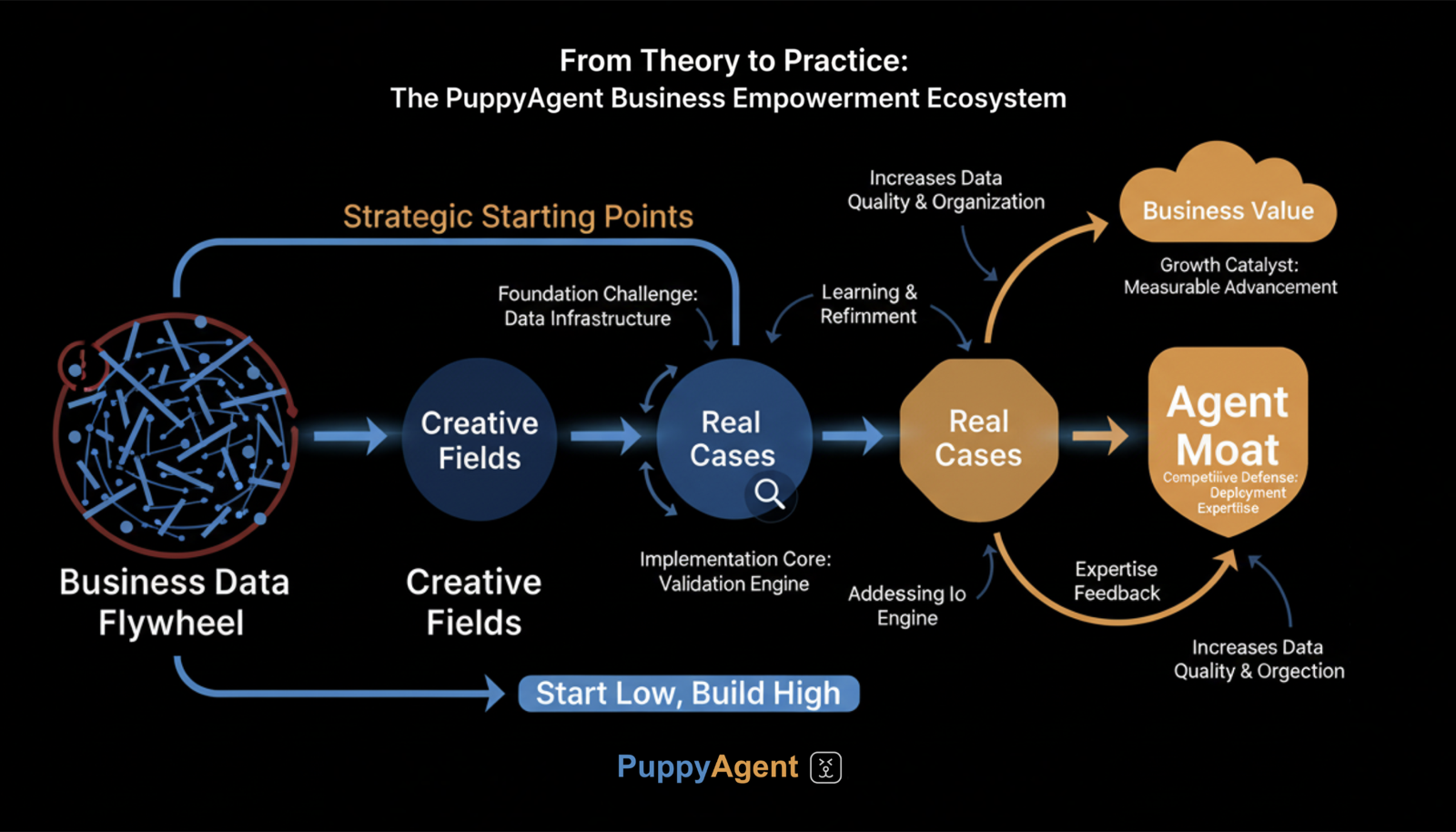

En esta situación incómoda, lo que puede ser más importante es poder usar Agentes para realmente crear más escenarios que agreguen valor comercial. Si la alta precisión no está disponible, uno puede comenzar con campos creativos que requieren menor precisión; si hay falta de datos, uno puede explorar puntos de entrada de negocio con más datos de código abierto. Lo fundamental es obtener más casos reales, para así construir el propio foso de Agentes en combate real.

Si también quieres dejar de lado el trabajo complicado que tienes en mano, por favor haz clic en "Comenzar" al lado para explorar las posibilidades comerciales que trae puppyone.

puppyone siempre ha estado explorando el uso de RAG interactivo dinámico y Agentes para servir al crecimiento comercial real en flujos de trabajo. Esperamos inspirar a los usuarios con cada caso de extremo a extremo, en lugar de presumir sobre nuestra generalizabilidad, ni estar confinados a un solo escenario vertical. Ahora hemos implementado numerosos casos en campos como servicio al cliente, alquiler de viviendas, asuntos legales y gestión de documentos. Puedes hacer clic para ver los videos de casos.

Conclusión

Los casos y compañías excelentes comparten una característica común: ya no se enfocan en crear el "Agente perfecto", sino en construir un "sistema de toma de decisiones colaborativo humano-máquina", estableciendo barandillas de seguridad en nodos clave y liberando la eficiencia del Agente en escenarios rutinarios.

Para compañías tambaleándose al borde del acantilado, la tarea principal es enfrentar la realidad: los Agentes generales no pueden hacer todo, y los Agentes verticales no pueden agarrar firmemente los recursos centrales. La verdadera salida radica en el pensamiento sistémico—combinando orgánicamente destilación de conocimiento de la industria, mejora de datos pequeños y verificación colaborativa humano-máquina para formar un "método de avance de tres pasos" implementable.

Fuente de la Imagen: puppyone

Fuente de la Imagen: puppyone

Podemos preguntarle repetidamente a Manus/Genspark, si un día OpenAI y Google realmente logran Agentes generales, ¿dónde estará tu competitividad? También podemos preguntar a OpenAI y Google cuáles son las dificultades reales en escalar escenarios y generalizar flujos de trabajo. Esencialmente, esto es una cuerda floja colgando entre acantilados.

¿Está tu compañía lista para caminar por esta cuerda floja?