90% des Agents IA sur la 'double falaise' : entre l'incapacité des modèles généraux et les limites des modèles spécialisés

Source de l'image : Puppyone

Source de l'image : Puppyone

Le rapport Gartner 2025 indique que 83% des projets IA d'entreprise échouent à répondre aux attentes. Tandis que l'industrie IA débat encore des mérites des "généralistes" versus "spécialistes verticaux", une réalité brutale émerge : 90% des entreprises d'Agents IA sont prises dans un double piège de "capacités générales insuffisantes + manque de données verticales". Dans ce dilemme sans bonne réponse, 90% des projets d'Agents se dirigent silencieusement vers l'échec, tandis que les survivants cherchent de nouvelles façons de rester en vie au bord de la falaise.

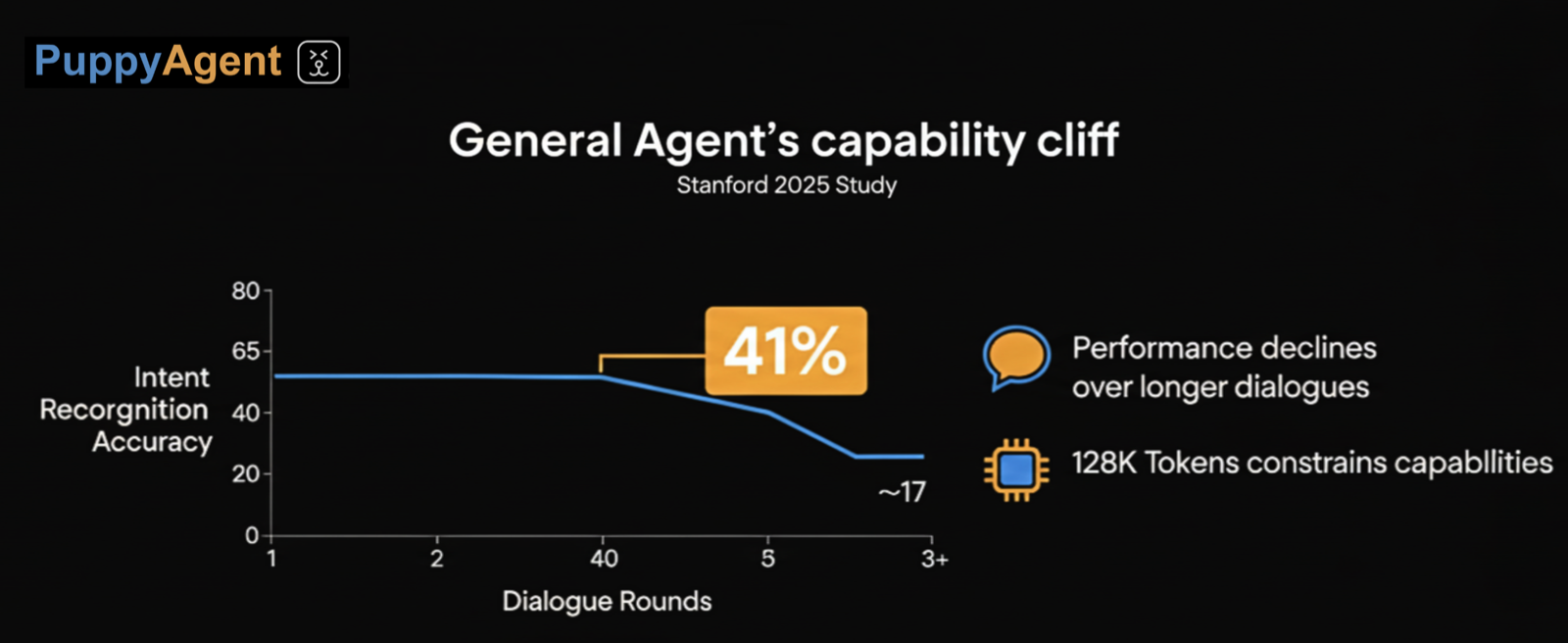

Falaise de Devant : La "Falaise de Capacité" des Agents Généraux

La compréhension d'intention et le suivi d'instructions sont deux capacités de base cruciales pour un Agent. Les modèles fondamentaux traditionnels ne peuvent plus répondre aux exigences des tâches complexes. Les Agents nécessitent des flux de travail diversifiés, des systèmes et des contrôles... encapsulant les modèles de base en systèmes implémentables.

La vision d'un Agent général est séduisante—une entité intelligente unique capable de résoudre des problèmes dans divers domaines.

Source de l'image : Puppyone

Source de l'image : Puppyone

Cependant, quand la plupart des entreprises tentent d'appliquer les soi-disant Agents IA généraux aux scénarios professionnels, elles rencontrent fréquemment une "falaise de capacité". Un test 2025 de l'Université Stanford a révélé un fait choquant : quand les instructions utilisateur dépassent trois tours de dialogue, la précision de reconnaissance d'intention des Agents généraux chute à 41%. Bien que des modèles comme Claude aient étendu le prompt système à 128K tokens, dans des scénarios multi-rôles, ces Agents confondent encore fréquemment les vrais besoins des utilisateurs, interprétant mal des demandes simples comme des décisions complexes.

Ce qui est plus dangereux, c'est le piège des hallucinations à grande échelle.

Dans des scénarios professionnels comme le contrôle des risques financiers, le taux d'erreur du contenu généré par les Agents généraux atteint 52%, et ces erreurs sont souvent présentées dans un ton professionnel, comme fabriquer des dispositions réglementaires ou inventer des données statistiques. Une banque a autrefois investi massivement dans le développement d'un Agent de contrôle des risques général, pour découvrir que son taux d'erreur dépassait 65% lors de la gestion de décisions composées impliquant "comportement historique client + fluctuations marché + changements politiques", forçant l'entreprise à investir 3,2 fois plus de main-d'œuvre pour vérification. Une expérience MIT sur la migration inter-domaines a prouvé que quand un Agent entraîné dans le domaine médical était transféré vers un scénario légal, le taux de réussite des tâches chutait de 78% à 32%. Le problème central réside dans la non-généralisabilité de l'espace d'action—quand l'interface d'Usage d'Outils passe d'une API médicale à une API financière, l'Agent ne peut pas ajuster adaptivement son espace d'action.

De nombreuses entreprises tombent dans une idée fausse dangereuse : équivaloir "pouvoir faire tourner une démo" avec "avoir une valeur métier".

Source de l'image : Puppyone

Source de l'image : Puppyone

Un constructeur automobile a autrefois investi 20 millions dans l'entraînement d'un "Agent de service client général", mais il a échoué dans des scénarios réels car il ne pouvait pas gérer des décisions composées impliquant "type de pneu + météo + habitudes de conduite". Cela révèle un paradoxe clé : plus un Agent général poursuit "l'omnipotence", plus sa fiabilité dans les scénarios verticaux diminue.

"Nous n'entraînons pas des agents intelligents ; nous habillons des hallucinations en tenue professionnelle." Le dilemme des Agents généraux n'est pas qu'ils ne peuvent pas tout faire, mais qu'ils ne peuvent même pas effectuer des actions de base de manière fiable dans des scénarios professionnels.

Falaise de Derrière : La "Falaise de Ressources" des Agents Verticaux

Quand les entreprises se tournent vers les Agents verticaux pour une percée, elles se retrouvent à tomber dans une autre "falaise de ressources".

Les données industrielles centrales sont comme un trésor enfermé sur une île : les données de diagnostic des hôpitaux de premier plan, les journaux de contrôle des risques bancaires et autres actifs clés sont inaccessibles à 91% des entreprises en raison de barrières de conformité. Ce qui est plus grave, c'est le piège de qualité des données. Une équipe IA industrielle a passé huit mois à obtenir des données de panne d'équipement, mais 67% ont été invalidées en raison de standards d'étiquetage incohérents—les données verticales nécessitent un savoir-faire industriel pour être utilisées correctement. Des cas réels montrent que le coût pour une entreprise IA médicale d'obtenir 100 000 points de données conformes et étiquetées a monté en flèche de 830 000 yuans en 2022 à 4,12 millions de yuans en 2024, une augmentation stupifiante de 400%.

Source de l'image : Puppyone

Source de l'image : Puppyone

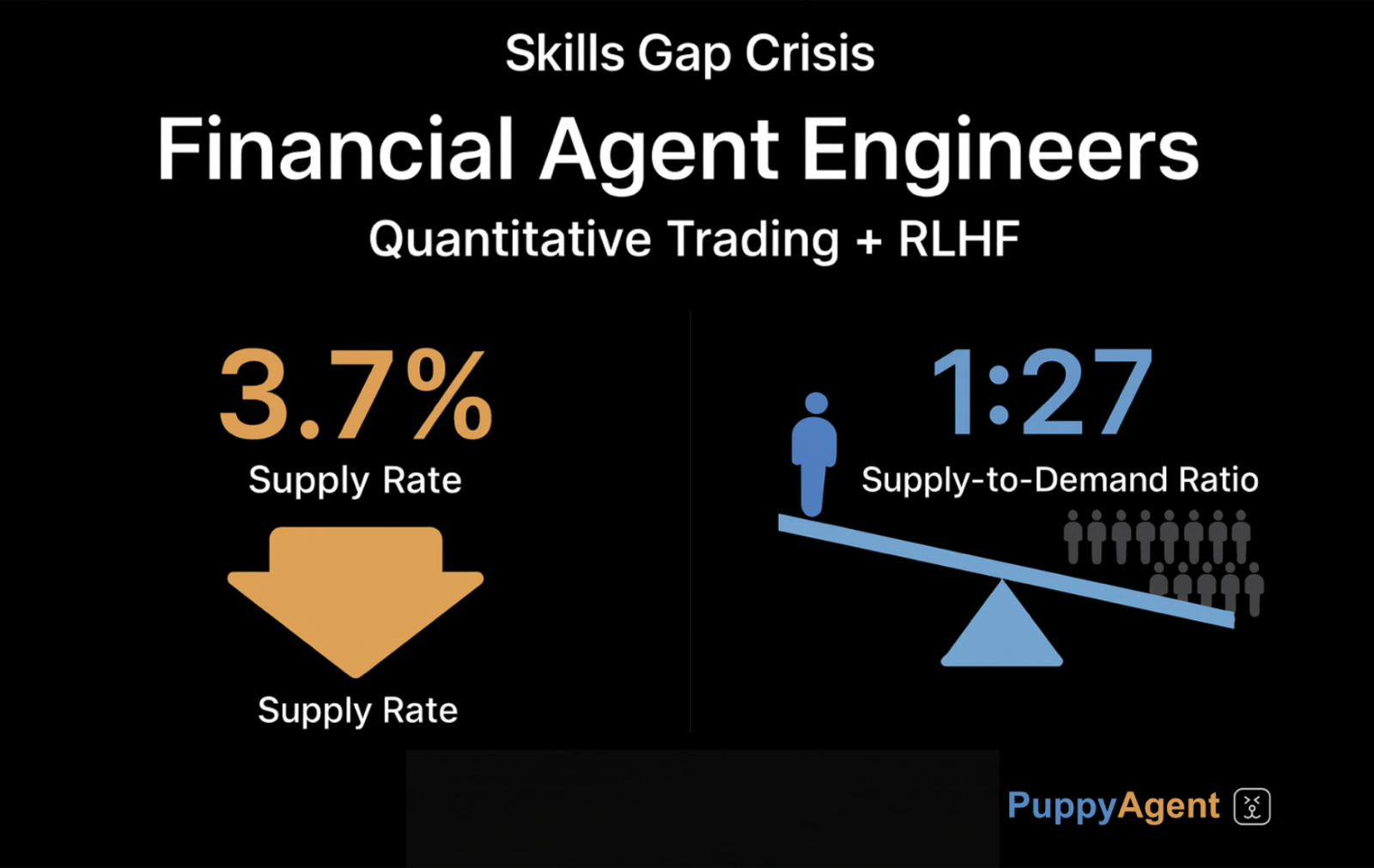

Encore plus rares que les données sont les talents hybrides qui peuvent combler le fossé entre technologie et industrie. Dans le développement d'Agents financiers, les ingénieurs qui peuvent maîtriser à la fois la logique de trading quantitatif et l'ajustement RLHF (Apprentissage par Renforcement à partir de Retour Humain) sont en pénurie, avec une disponibilité marché de moins de 3,7% de la demande, résultant en un ratio offre-demande stupifiant de 1:27. La rupture de communication entre experts industriels et ingénieurs IA mène souvent à des résultats désastreux : les experts industriels produisent des "fragments de règles" vagues basés sur l'expérience, que les ingénieurs IA forcent ensuite dans des "graphes de connaissances erronés", causant aux Agents finaux de dévier significativement de l'essence du métier. Un client manufacturier a demandé le développement d'un "Agent de prédiction de panne d'équipement", mais les experts industriels étaient incapables de décrire les "caractéristiques spectrales du bruit de roulement" en termes techniques, menant à un entraînement de modèle qui ratait complètement les exigences réelles.

Le dilemme des Agents verticaux ne concerne pas seulement l'incapacité d'obtenir des données, mais aussi l'incapacité de comprendre ou d'utiliser les données correctement même quand elles sont obtenues.

Stratégie de Survie : La Méthode de Percée en Trois Étapes pour Franchir la Double Falaise

Actuellement, la plupart des modèles de base reposent sur la distillation de séries de modèles comme GPT et Claude. La majorité des données n'ont pas été étiquetées pour leurs propres scénarios métier et conditions régionales/nationales. Construire simplement des flux de travail et ajouter RAG (Génération Augmentée par Récupération) et autres moyens ne peut pas atteindre de vraies capacités d'implémentation de bout en bout.

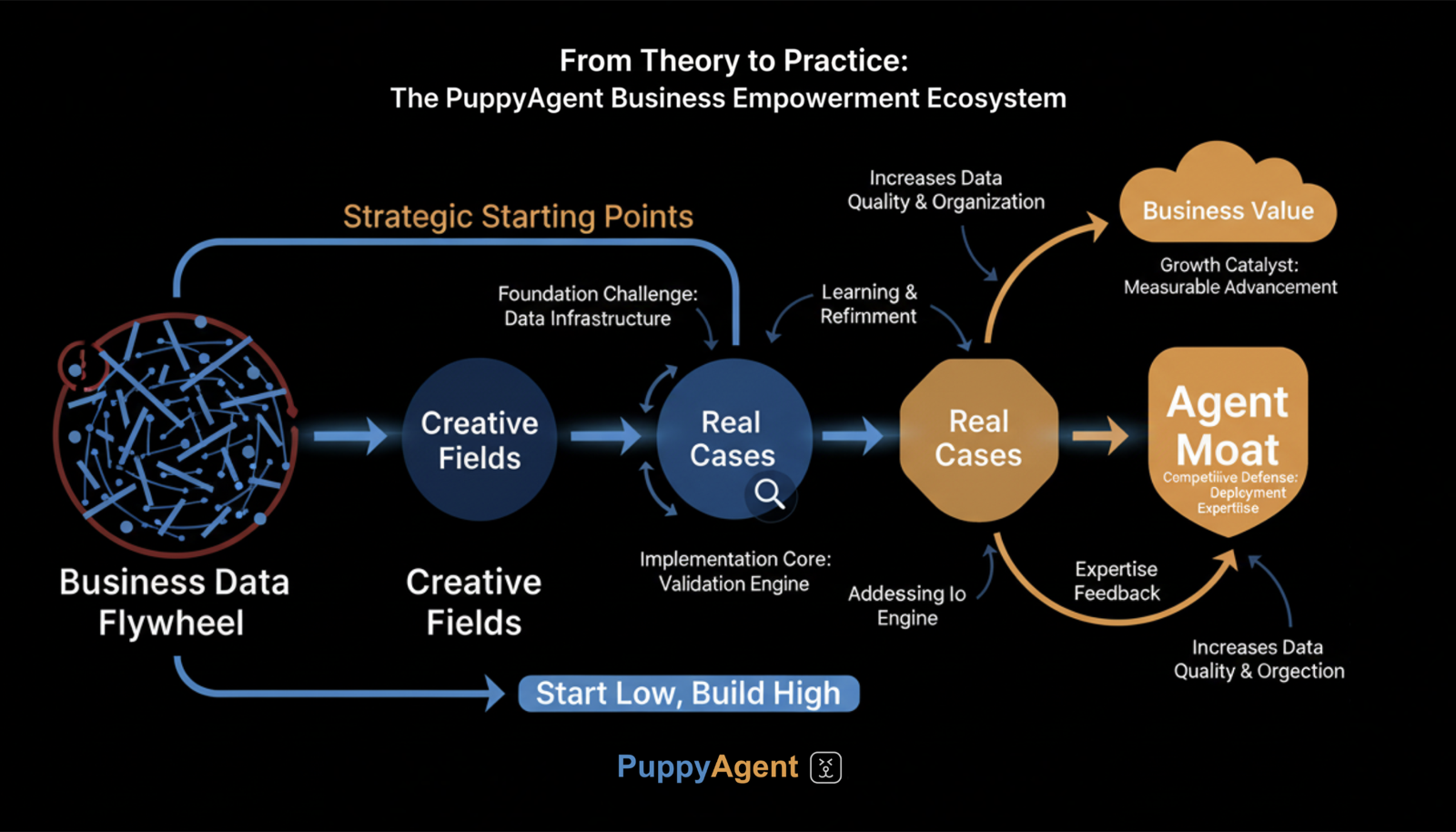

De nombreuses entreprises ou organisations n'ont même pas trié leurs propres volants de données métier, encore moins conduire la croissance métier avec des Agents.

Source de l'image : pexels

Source de l'image : pexels

Dans cette situation gênante, ce qui peut être plus important est de pouvoir utiliser des Agents pour véritablement créer plus de scénarios ajoutant de la valeur métier. Si une haute précision n'est pas disponible, on peut commencer par des domaines créatifs qui nécessitent une précision plus faible ; s'il y a un manque de données, on peut explorer des points d'entrée métier avec plus de données open-source. La chose fondamentale est d'obtenir plus de cas réels, afin de construire son propre fossé d'Agent dans le combat réel.

Si vous voulez aussi vous débarrasser du travail compliqué en cours, veuillez cliquer sur "Commencer" sur le côté pour explorer les possibilités métier apportées par puppyone.

puppyone a toujours exploré l'utilisation de RAG interactif dynamique et d'Agents pour servir la vraie croissance métier dans les flux de travail. Nous espérons inspirer les utilisateurs avec chaque cas de bout en bout, plutôt que de nous vanter de notre généralisabilité, ni d'être confinés à un seul scénario vertical. Nous avons maintenant implémenté de nombreux cas dans des domaines comme le service client, la location immobilière, les affaires légales et la gestion documentaire. Vous pouvez cliquer pour regarder les vidéos de cas.

Conclusion

Les excellents cas et entreprises partagent tous une caractéristique commune : ils ne se concentrent plus sur la création de l'"Agent parfait", mais sur la construction d'un "système de prise de décision collaboratif humain-machine", établissant des garde-fous de sécurité aux nœuds clés et libérant l'efficacité d'Agent dans les scénarios de routine.

Pour les entreprises vacillant au bord de la falaise, la tâche primaire est de faire face à la réalité : les Agents généraux ne peuvent pas tout faire, et les Agents verticaux ne peuvent pas saisir fermement les ressources centrales. La vraie sortie réside dans la pensée systémique—combinant organiquement la distillation de connaissances industrielles, l'amélioration de petites données et la vérification collaborative humain-machine pour former une "méthode de percée en trois étapes" implémentable.

Source de l'image : Puppyone

Source de l'image : Puppyone

Nous pouvons demander à plusieurs reprises à Manus/Genspark, si un jour OpenAI et Google atteignent vraiment des Agents généraux, où sera votre compétitivité ? Nous pouvons aussi demander à OpenAI et Google quelles sont les vraies difficultés dans la mise à l'échelle des scénarios et la généralisation des flux de travail. Essentiellement, c'est une corde raide suspendue entre des falaises.

Votre entreprise est-elle prête à marcher sur cette corde raide ?